WebMCP ব্যাখ্যা: AI এজেন্টরা ওয়েব বদলে দিচ্ছে

সূচিপত্র

2026 সালের মার্চে Cloudflare-এর CEO Matthew Prince SXSW-তে বলেন যে 2027 সালের মধ্যে bot traffic মানুষের traffic-কে ছাড়িয়ে যেতে পারে। এর পেছনের যুক্তিটা বোঝা কঠিন নয়: একজন মানুষ কয়েকটা tab খোলে। কিন্তু একটি agent একই কাজের জন্য parallel-এ শত শত বা হাজার হাজার request পাঠাতে পারে, sources compare করতে পারে, আর actions prepare করতে পারে।

অনেক operator-এর কাছে bots মানেই আগে ছিল security problem: scraper, spam, আর DDoS attack । কিন্তু browser agent আর AI workflow-এর সঙ্গে এখন আরেকটি category তৈরি হচ্ছে: এমন bots, যারা কিছু ভাঙতে নয়, বরং পড়তে, evaluate করতে, আর আপনার হয়ে কাজ করতে আসে।

ঠিক এই জায়গাতেই WebMCP গুরুত্বপূর্ণ হয়ে ওঠে। এটি কোনও final web standard নয়, বরং এমন একটি early concept, যেখানে website আর browser-এর ভেতরের agent আরও structured way-এ interact করতে পারে।

WebMCP কী?

WebMCP হলো একটি early approach, যা website-কে browser-এর ভেতরের agent-এর জন্য explicit capabilities এবং context expose করতে দেয়। অর্থাৎ agent-কে শুধু HTML দেখে আন্দাজ করতে হবে না, কিংবা DOM scraping করে কষ্ট করে button বা form বুঝতে হবে না; website আরও পরিষ্কারভাবে বলতে পারবে কোন action কীভাবে available।

মূল ধারণাটা সহজ:

- Website শুধু visual interface নয়, structured capabilities expose করে।

- Agent browser context-এর ভেতর সেই capabilities আরও নির্ভুলভাবে ব্যবহার করতে পারে।

- User tab-এর flow-এর মধ্যে থাকে, প্রতিটি ধাপ হাতে ক্লিক করে যেতে হয় না।

এখানে গুরুত্বপূর্ণ বিষয় হলো সঠিক framing: এপ্রিল 2026 পর্যন্ত WebMCP W3C-এর ratified standard নয়, এবং এটি broadly available browser feature-ও নয়। এটি এখনো draft বা preview পর্যায়ের একটি direction, যেটা Chrome publicly আলোচনা করছে এবং পরীক্ষা করছে।

MCP আর WebMCP-এর মধ্যে পার্থক্য কী?

এখানেই অনেক discussion অস্পষ্ট হয়ে যায়। WebMCP শুধু “website-এর জন্য MCP” নয়, আর MCP-এর direct successor-ও নয়।

- MCP সাধারণভাবে বোঝায় কীভাবে model আর client tools, data sources, আর services-এর সঙ্গে কথা বলবে।

- WebMCP নির্দিষ্টভাবে সেই case-টা নিয়ে কাজ করে, যেখানে একটি agent browser-এর ভেতরে website-এর সঙ্গে interact করছে।

- তাই MCP আর WebMCP related problem solve করলেও, তারা এক জিনিস নয়।

এই distinction গুরুত্বপূর্ণ। না হলে সহজেই এমন impression তৈরি হয় যে পুরো open web খুব তাড়াতাড়ি একটা নতুন standard-এ migrate করতে যাচ্ছে। বাস্তবে আমরা এখনো সেখানে পৌঁছাইনি।

2027-এর মধ্যে bot traffic এত বাড়তে পারে কেন?

এর মূল কারণ হলো Prince যে fan-out effect-এর কথা বলেছেন। আপনি যদি আজ একটি laptop খুঁজেন, হয়তো 5 থেকে 10টা page খুলবেন। কিন্তু একটি agent একই কাজকে parallel work-এ ভেঙে ফেলতে পারে:

- একই সঙ্গে একাধিক retailer check করে।

- Delivery time, price, return policy, আর warranty compare করে।

- Duplicate, ads, আর irrelevant result filter করে।

- Raw browsing noise-এর বদলে decision summary ফিরিয়ে দেয়।

ঠিক কতগুলো request হবে, সেটা task-এর উপর নির্ভর করে। কিন্তু direction পরিষ্কার: agent প্রতি user-এর query volume বাড়িয়ে দেয়, কারণ তারা parallel-এ কাজ করে এবং মানুষের চেয়ে অনেক বেশি intermediate step automate করতে পারে।

আমার ব্যক্তিগত পরিবর্তন: searching থেকে delegating

আমি নিজেই এই পরিবর্তনটা খুব স্পষ্টভাবে অনুভব করছি। আগে research মানে ছিল query লেখা, তিন থেকে দশটা tab খোলা, খারাপ content বাদ দেওয়া, query refine করা, তারপর আবার শুরু করা। এখন আমি সেই কাজের বড় অংশ delegate করে দিই।

আমার দৈনন্দিন workflow থেকে একটি concrete example: যখন আমি নতুন hardware, security update, বা tools-এর পরিবর্তন track করি, তখন শুধু one-off search করি না। আমার agentরা এসব topic বারবার check করে, filter করে, আর prioritize করে। Critical hit সরাসরি phone-এ push alert হিসেবে আসে। Less urgent item dashboard-এ বা reading list-এ যায়।

এখানে পার্থক্য শুধু convenience নয়। আসল পার্থক্য হলো এমন setup continuous traffic generate করে, এমনকি যখন আমি actively browsing করছি না। শুধু এই বিষয়টাই বোঝায় কেন bot traffic statistically human session-এর চেয়ে অনেক দ্রুত বাড়তে পারে।

Website আর SEO-এর জন্য এর মানে কী?

আমি মনে করি না classic SEO “মরে গেছে”। তবে আমি এটাকে খুবই সম্ভব মনে করি যে SEO-কে আরও একটি layer দিয়ে complement করা হবে। শুধু search engine-এর জন্য content understandable হওয়াই যথেষ্ট নয়। ক্রমশ agentদেরও content extract, compare, আর নিজের context-এ incorporate করতে হবে।

এই next layer-এর জন্য চারটি বিষয় সবচেয়ে গুরুত্বপূর্ণ:

- পরিষ্কার structure: heading, table, form, আর semantic HTML স্পষ্ট হতে হবে।

- Machine-readable data: Schema.org, consistent metadata, আর clearly named field marketing copy-এর চেয়ে বেশি কাজে আসে।

- Accessible flow: গুরুত্বপূর্ণ info বা action যদি brittle JavaScript-এর আড়ালে লুকানো থাকে, তাহলে agent অকারণে slow হয়ে যায়।

- Latency এবং reliability: যে site দ্রুত, স্থিতিশীল, আর predictable response দেয়, তার technical advantage থাকবে।

এই context-এ AEO (Agent Engine Optimization) শব্দটা আরও বেশি শোনা যাবে। আমি এটাকে SEO-এর replacement হিসেবে দেখি না; বরং agentic system-এর জন্য additional visibility discipline হিসেবে দেখি।

এখন operator-দের কী করা উচিত?

আপনি যদি আজ একটি website, portal, বা application চালান, তাহলে hype দিয়ে শুরু করব না। আমি hygiene দিয়ে শুরু করব:

- Structured data বাড়ান। কোথায়

Schema.orgalready logical, সেটা review করুন: article, product, FAQ, organization data, breadcrumb। - গুরুত্বপূর্ণ content friction ছাড়া reachable করুন। Price, availability, specification, contact path, আর core functionality যেন fragile UI trick-এর আড়ালে না থাকে।

- Form আর interaction flow simplify করুন। Clear label, stable button, predictable state, আর clean HTML মানুষ ও agent দুজনের জন্যই ভালো।

- Performance কঠোরভাবে measure করুন। Slow response time, unnecessary redirect, আর unstable frontend visibility ও usability দুটোই কমায়।

- Bot traffic সঠিকভাবে আলাদা করুন। সব bot খারাপ নয়, কিন্তু সব bot valuable-ও নয়। Monitoring, rate limit, আর clear policy আরও গুরুত্বপূর্ণ হবে।

- যেখানে business sense আছে, সেখানে structured access দিন। সেটা API, feed, clean metadata, বা future-এ আরও agent-friendly browser flow হতে পারে।

যদি agent-ই click করে, তাহলে internet-এর খরচ কে দেবে?

অর্থনৈতিক প্রশ্নটা technical question-এর মতোই গুরুত্বপূর্ণ। Alphabet Q4 2025-এ 82.3 বিলিয়ন ডলার advertising revenue report করেছে, আর Meta একই সময়ে প্রায় 58.1 বিলিয়ন ডলার। এই সংখ্যাগুলো খুব পরিষ্কারভাবে দেখায়: আজকের web এখনো attention, click, আর ad inventory-এর উপর গভীরভাবে নির্ভরশীল।

যদি userরা increasingly agent-এর মাধ্যমে answer consume করে, নিজে page visit না করে, তাহলে existing model-এর উপর চাপ পড়বে। এর মানে এই নয় যে advertising হঠাৎ vanish করবে। কিন্তু এর মানে হলো direct access, data licensing, API, আর subscription-style model আরও গুরুত্বপূর্ণ হয়ে উঠতে পারে।

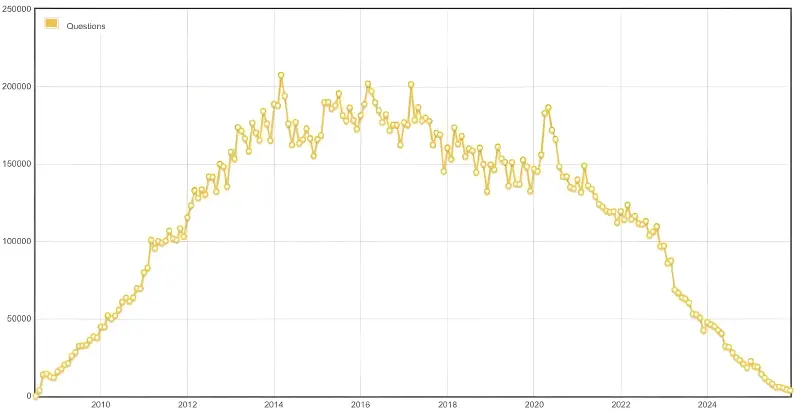

এই দিকের একটি interesting signal আসে Stack Overflow থেকে। AI boom-এর পর থেকে নতুন question-এর volume visibly চাপের মধ্যে আছে, আর company তার knowledge base ও data licensing-কে আরও product হিসেবে position করছে। এটা এখনো universal new model prove করে না, কিন্তু direction দেখায়: future value শুধু pageview থেকে নয়, বরং licensed, structured access to knowledge থেকেও আসতে পারে।

FAQ

WebMCP কি এখনই official web standard?

WebMCP কি MCP-এরই আরেক নাম?

এর মানে কি SEO শেষ?

AI agent-এর জন্য website কি এখনই rebuild করতে হবে?

Agent থাকলে bot traffic এত বেশি বাড়ে কেন?

উপসংহার

আপনি যদি আজ একটি website চালান, তাহলে panic করার বা আগামীকালই সবকিছু WebMCP ঘিরে rebuild করার দরকার নেই। কিন্তু এখনই দেখে নেওয়া উচিত আপনার content structured, fast, machine-readable, আর cleanly accessible কি না।

কারণ agentic future-এ এটাই ঠিক করবে আপনার site শুধু দেখতে ভালো লাগবে, নাকি সত্যিই গুরুত্বপূর্ণ systemগুলোর জন্য usable হবে।

Cheers, Joe

Sources and further reading

- TechCrunch: Cloudflare CEO says online bot traffic will exceed human traffic by 2027

- Chrome for Developers: WebMCP Early Preview Program

- Chrome for Developers: When to use WebMCP and MCP

- WebMCP Draft

- Alphabet: Q4 2025 Earnings Release

- Meta: Q4 2025 Results

- Stack Overflow Data Licensing

- Prosus HY2026 Summary Consolidated Financial Statements

আবার দেখা হবে,

Joe