WebMCP erklärt: KI-Agenten verändern das Web

Inhaltsverzeichnis

Im März 2026 sagte Cloudflare-CEO Matthew Prince auf der SXSW, dass Bot-Traffic bis 2027 den menschlichen Traffic übersteigen könnte. Die zugrunde liegende Logik ist nachvollziehbar: Ein Mensch öffnet ein paar Tabs. Ein Agent kann für dieselbe Aufgabe parallel Hunderte oder Tausende Requests auslösen, Quellen vergleichen und Aktionen vorbereiten.

Für viele Betreiber waren Bots bisher vor allem ein Security-Thema: Scraper, Spam und DDoS-Angriffe . Mit Browser-Agenten und KI-Workflows kommt jetzt eine zweite Kategorie dazu: Bots, die nicht zerstören, sondern lesen, auswerten und in deinem Namen handeln sollen.

Genau an dieser Stelle wird WebMCP interessant. Nicht als fertiger neuer Web-Standard, sondern als frühes Konzept dafür, wie Websites und Browser-Agenten strukturierter miteinander interagieren könnten.

Was ist WebMCP?

WebMCP ist ein früher Ansatz, mit dem Websites einem Agenten im Browser explizite Funktionen und Kontexte anbieten können. Statt dass ein Agent nur HTML errät und Buttons oder Formulare mühsam per DOM-Scraping interpretiert, kann eine Website klarer beschreiben, welche Aktionen möglich sind.

Die Grundidee ist einfach:

- Eine Website stellt strukturierte Fähigkeiten bereit, statt nur visuelle Oberflächen.

- Ein Agent kann diese Fähigkeiten im Browser-Kontext gezielter nutzen.

- Der Nutzer bleibt im Flow des Tabs, statt jeden Schritt manuell durchklicken zu müssen.

Wichtig ist die Einordnung: Stand April 2026 ist WebMCP kein verabschiedeter W3C-Standard und kein flächendeckend verfügbares Browser-Feature. Es handelt sich um einen frühen Draft bzw. Preview-Ansatz, den Chrome öffentlich diskutiert und testet.

Was ist der Unterschied zwischen MCP und WebMCP?

Hier wird in vielen Diskussionen unsauber formuliert. WebMCP ist nicht einfach “MCP für Websites” und auch nicht der direkte Nachfolger von MCP.

- MCP beschreibt allgemein, wie Modelle und Clients mit Tools, Datenquellen und Diensten sprechen können.

- WebMCP adressiert den speziellen Fall, dass ein Agent direkt im Browser mit einer Website interagiert.

- MCP und WebMCP lösen also verwandte, aber unterschiedliche Probleme.

Das ist wichtig, weil du sonst schnell den Eindruck bekommst, das gesamte offene Web werde kurzfristig auf einen neuen Standard umgestellt. So weit sind wir nicht.

Warum könnte Bot-Traffic bis 2027 stark steigen?

Der Kernpunkt ist der von Prince beschriebene Fan-out-Effekt. Wenn du heute ein Notebook suchst, klickst du vielleicht 5 bis 10 Seiten an. Ein Agent kann dieselbe Anfrage aufsplitten:

- Er prüft mehrere Shops parallel.

- Er vergleicht Lieferzeiten, Preise, Rückgabebedingungen und Garantien.

- Er filtert Dubletten, Werbung und irrelevante Treffer heraus.

- Er liefert dir nur noch eine verdichtete Entscheidungsvorlage.

Die konkrete Zahl der Requests variiert natürlich je nach Aufgabe. Die Richtung ist aber klar: Agenten vervielfachen Abfragen pro Nutzer, weil sie parallel arbeiten und mehr Zwischenschritte automatisieren als ein Mensch.

Mein persönlicher Shift: Vom Suchen zum Delegieren

Genau diesen Wandel merke ich bei mir selbst schon deutlich. Früher bestand Recherche oft aus Suchbegriff, drei bis zehn Tabs, Content-Müll aussortieren, neuen Suchbegriff eingeben, wiederholen. Heute delegiere ich viele dieser Schritte.

Ein konkretes Beispiel aus meinem Alltag: Wenn ich neue Hardware, Security-Meldungen oder Änderungen bei Tools beobachte, lasse ich Agenten nicht nur einmal suchen, sondern wiederkehrend prüfen, filtern und priorisieren. Kritische Treffer landen direkt als Push auf dem Handy. Weniger dringende Themen wandern in ein Dashboard oder in eine spätere Leseliste.

Der Unterschied ist nicht nur Komfort. Der Unterschied ist, dass solche Setups kontinuierlich Traffic erzeugen, auch wenn ich gerade nicht aktiv browse. Genau dadurch wird verständlich, warum Bot-Traffic statistisch deutlich schneller wachsen kann als menschliche Sessions.

Was bedeutet das für Websites und SEO?

Ich glaube nicht, dass klassische SEO “tot” ist. Aber ich halte es für sehr plausibel, dass sie ergänzt wird. Nicht nur Suchmaschinen müssen deine Inhalte verstehen, sondern zunehmend auch Agenten, die Informationen extrahieren, vergleichen und in ihren eigenen Kontext einbauen.

Für diese neue Ebene zählen vor allem vier Dinge:

- Saubere Struktur: Überschriften, Tabellen, Formulare und semantisches HTML müssen eindeutig sein.

- Maschinenlesbare Daten: Schema.org, konsistente Metadaten und klar benannte Felder helfen mehr als blumige Marketingtexte.

- Zugängliche Abläufe: Wenn wichtige Informationen oder Aktionen hinter fragilen JavaScript-Konstrukten versteckt sind, werden Agenten unnötig ausgebremst.

- Latenz und Zuverlässigkeit: Wer schnell, stabil und vorhersehbar antwortet, ist technisch im Vorteil.

Der Begriff AEO (Agent Engine Optimization) wird in diesem Kontext häufiger fallen. Ich würde ihn nicht als Ersatz für SEO sehen, sondern als zusätzliche Sichtbarkeitsdisziplin für agentische Systeme.

Was Betreiber jetzt konkret tun sollten

Wenn du heute eine Website, ein Portal oder eine App betreibst, würde ich nicht mit Hype anfangen, sondern mit Hygiene:

- Strukturierte Daten ausbauen. Prüfe, wo

Schema.orgbereits sinnvoll ist: Artikel, Produkte, FAQ, Organisation, Breadcrumbs. - Wichtige Inhalte ohne unnötige Hürden erreichbar machen. Preise, Verfügbarkeit, Spezifikationen, Kontaktwege und Kernfunktionen sollten nicht hinter fragilen UI-Tricks versteckt sein.

- Formulare und Interaktionspfade vereinfachen. Klare Labels, stabile Buttons, vorhersehbare States und sauberes HTML helfen Menschen und Agenten zugleich.

- Performance konsequent messen. Langsame Antwortzeiten, unnötige Weiterleitungen und instabile Frontends kosten Sichtbarkeit und Nutzbarkeit.

- Bot-Traffic sauber unterscheiden. Nicht jeder Bot ist böse, aber nicht jeder Bot ist wertvoll. Monitoring, Rate Limits und klare Policies werden wichtiger.

- Dort, wo es geschäftlich sinnvoll ist, strukturierte Zugänge anbieten. Das kann eine API, ein Feed, saubere Metadaten oder künftig ein agentenfreundlicher Browser-Flow sein.

Wer bezahlt das Internet, wenn Agenten klicken?

Die wirtschaftliche Frage dahinter ist mindestens so spannend wie die technische. Alphabet meldete für Q4 2025 Werbeerlöse von 82,3 Milliarden US-Dollar, Meta im gleichen Zeitraum rund 58,1 Milliarden US-Dollar. Diese Zahlen zeigen vor allem eines: Das heutige Web hängt massiv an Aufmerksamkeit, Klicks und Anzeigeninventar.

Wenn Nutzer immer öfter Antworten über Agenten konsumieren, statt Seiten selbst aufzurufen, dann setzt das bestehende Modelle unter Druck. Das heißt nicht automatisch, dass Werbung verschwindet. Aber es heißt, dass Direktzugriff, Datenlizenzierung, APIs und abonnementartige Modelle an Gewicht gewinnen könnten.

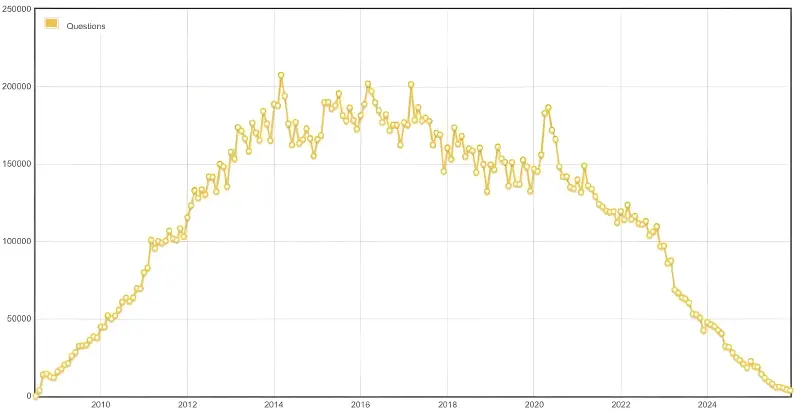

Ein interessantes Signal in diese Richtung kommt von Stack Overflow. Die Zahl neuer Fragen ist seit dem KI-Boom sichtbar unter Druck geraten, während das Unternehmen sein Wissen und seine Datenlizenzierung offensiver als Produkt positioniert. Das beweist noch kein neues Universalmodell, zeigt aber die Tendenz: Wert entsteht künftig nicht nur über Seitenaufrufe, sondern auch über lizenzierbaren, strukturierten Wissenszugang.

FAQ

Ist WebMCP schon ein offizieller Webstandard?

Ist WebMCP das Gleiche wie MCP?

Bedeutet das das Ende von SEO?

Müssen Websites jetzt sofort für KI-Agenten umgebaut werden?

Warum steigt Bot-Traffic durch Agenten überhaupt so stark?

Fazit

Wenn du heute eine Website betreibst, musst du nicht in Panik verfallen und morgen alles auf WebMCP umbauen. Aber du solltest jetzt prüfen, ob deine Inhalte strukturiert, schnell, maschinenlesbar und sauber zugänglich sind.

Denn genau dort entscheidet sich, ob du in einer agentischen Web-Zukunft nur hübsch aussiehst oder auch tatsächlich verwertbar bist.

Cheers, Joe

Quellen und weiterführende Links

- TechCrunch: Cloudflare-CEO erwartet mehr Bot- als Human-Traffic bis 2027

- Chrome for Developers: WebMCP Early Preview Program

- Chrome for Developers: When to use WebMCP and MCP

- WebMCP Draft

- Alphabet: Q4 2025 Earnings Release

- Meta: Q4 2025 Results

- Stack Overflow Data Licensing

- Prosus HY2026 Summary Consolidated Financial Statements