WebMCP explicado: los agentes de IA están cambiando la web

Tabla de contenidos

En marzo de 2026, el CEO de Cloudflare, Matthew Prince, dijo en SXSW que el tráfico de bots podría superar al tráfico humano en 2027. La lógica detrás de esa afirmación es fácil de entender: una persona abre unas cuantas pestañas. Un agente puede lanzar cientos o miles de solicitudes en paralelo para la misma tarea, comparar fuentes y preparar acciones.

Para muchos operadores, los bots solían ser sobre todo un problema de seguridad: scrapers, spam y ataques DDoS . Con los agentes de navegador y los flujos de trabajo con IA, ahora aparece una segunda categoría: bots que no intentan romper nada, sino leer, evaluar y actuar en tu nombre.

Ahí es exactamente donde WebMCP se vuelve interesante. No como un nuevo estándar web ya terminado, sino como un concepto temprano de cómo los sitios web y los agentes dentro del navegador podrían interactuar de forma más estructurada.

¿Qué es WebMCP?

WebMCP es un enfoque temprano que permite a los sitios web exponer capacidades explícitas y contexto a un agente dentro del navegador. En lugar de obligar al agente a adivinar a partir del HTML e interpretar botones o formularios mediante DOM scraping, un sitio puede describir con más claridad qué acciones están disponibles.

La idea central es simple:

- Un sitio web expone capacidades estructuradas en lugar de limitarse a una interfaz visual.

- Un agente puede usar esas capacidades con más precisión dentro del contexto del navegador.

- El usuario se mantiene dentro del flujo de la pestaña en vez de hacer clic manualmente en cada paso.

La precisión aquí importa: a fecha de abril de 2026, WebMCP no es un estándar ratificado del W3C ni una función disponible de forma amplia en los navegadores. Es una dirección temprana, todavía en borrador o vista previa, que Chrome está discutiendo y probando públicamente.

¿Cuál es la diferencia entre MCP y WebMCP?

Aquí es donde muchas conversaciones se vuelven imprecisas. WebMCP no es simplemente “MCP para sitios web”, ni tampoco el sucesor directo de MCP.

- MCP describe de forma general cómo los modelos y clientes pueden hablar con herramientas, fuentes de datos y servicios.

- WebMCP aborda el caso específico en el que un agente interactúa con un sitio web dentro del navegador.

- MCP y WebMCP resuelven problemas relacionados, pero distintos.

Esa distinción es importante. De lo contrario, resulta fácil dar la impresión de que toda la web abierta está a punto de migrar de golpe a un único estándar nuevo. No estamos ahí.

¿Por qué podría crecer con fuerza el tráfico de bots hasta 2027?

La clave es el efecto fan-out que describió Prince. Si hoy buscas un portátil, quizá abras entre 5 y 10 páginas. Un agente puede dividir esa misma tarea en trabajo paralelo:

- Consulta varias tiendas al mismo tiempo.

- Compara tiempos de envío, precios, políticas de devolución y garantías.

- Filtra duplicados, anuncios y resultados irrelevantes.

- Te devuelve un resumen de decisión en lugar de ruido de navegación.

El número exacto de solicitudes depende de la tarea. Pero la dirección es clara: los agentes multiplican el número de consultas por usuario, porque trabajan en paralelo y automatizan más pasos intermedios que una persona.

Mi cambio personal: de buscar a delegar

Yo ya noto ese cambio claramente en mi propio flujo de trabajo. Antes, investigar significaba escribir una búsqueda, abrir de tres a diez pestañas, descartar contenido basura, refinar la consulta y volver a empezar. Hoy delego gran parte de ese trabajo.

Un ejemplo concreto de mi día a día: cuando sigo nuevo hardware, avisos de seguridad o cambios en herramientas, no hago búsquedas puntuales sin más. Tengo agentes que revisan esos temas de forma recurrente, los filtran y los priorizan. Lo crítico me llega directamente al móvil como push. Lo menos urgente va a un dashboard o a una lista de lectura para después.

La diferencia no es solo comodidad. La diferencia es que ese tipo de configuraciones genera tráfico de forma continua, incluso cuando yo no estoy navegando activamente. Solo eso ya ayuda a entender por qué el tráfico de bots puede crecer mucho más rápido, estadísticamente, que las sesiones humanas.

¿Qué significa esto para los sitios web y el SEO?

No creo que el SEO clásico esté “muerto”. Pero sí creo que es muy probable que vaya a complementarse. Ya no basta con que los buscadores entiendan tu contenido. Cada vez más, también los agentes tendrán que extraerlo, compararlo e incorporarlo a su propio contexto.

Para esa siguiente capa, hay cuatro cosas que importan especialmente:

- Estructura limpia: encabezados, tablas, formularios y HTML semántico deben ser inequívocos.

- Datos legibles por máquina: Schema.org, metadatos consistentes y campos claramente nombrados ayudan más que un texto de marketing florido.

- Flujos accesibles: si la información clave o las acciones están escondidas detrás de construcciones JavaScript frágiles, los agentes se frenan innecesariamente.

- Latencia y fiabilidad: los sitios que responden rápido, de forma estable y predecible, tendrán ventaja técnica.

Vas a oír cada vez más el término AEO (Agent Engine Optimization) en este contexto. Yo no lo trataría como un reemplazo del SEO, sino como una disciplina adicional de visibilidad para sistemas agentivos.

Qué deberían hacer ahora los operadores

Si hoy gestionas un sitio web, un portal o una aplicación, yo no empezaría por el hype. Empezaría por la higiene:

- Ampliar los datos estructurados. Revisa dónde

Schema.orgya tiene sentido: artículos, productos, FAQs, datos de organización, breadcrumbs. - Hacer accesible lo importante sin fricción innecesaria. Precios, disponibilidad, especificaciones, vías de contacto y funcionalidad principal no deberían quedar ocultos detrás de trucos de interfaz frágiles.

- Simplificar formularios y flujos de interacción. Etiquetas claras, botones estables, estados predecibles y HTML limpio ayudan tanto a personas como a agentes.

- Medir el rendimiento con rigor. Respuestas lentas, redirecciones innecesarias e interfaces inestables reducen visibilidad y usabilidad.

- Separar bien el tráfico de bots. No todo bot es malicioso, pero tampoco todo bot aporta valor. El monitoring, los rate limits y las políticas claras van a importar más.

- Ofrecer acceso estructurado donde tenga sentido de negocio. Eso puede ser una API, un feed, metadatos limpios o, en el futuro, un flujo de navegador más amigable para agentes.

¿Quién paga internet si los agentes hacen los clics?

La pregunta económica es, como mínimo, tan interesante como la técnica. Alphabet reportó 82.300 millones de dólares en ingresos publicitarios en el Q4 de 2025, mientras que Meta reportó aproximadamente 58.100 millones en el mismo periodo. Esas cifras dejan algo claro: la web actual sigue profundamente ligada a la atención, a los clics y al inventario publicitario.

Si los usuarios consumen cada vez más respuestas a través de agentes en lugar de visitar páginas por sí mismos, eso pone presión sobre el modelo actual. Eso no significa automáticamente que la publicidad vaya a desaparecer. Pero sí sugiere que el acceso directo, las licencias de datos, las APIs y los modelos tipo suscripción podrían ganar peso.

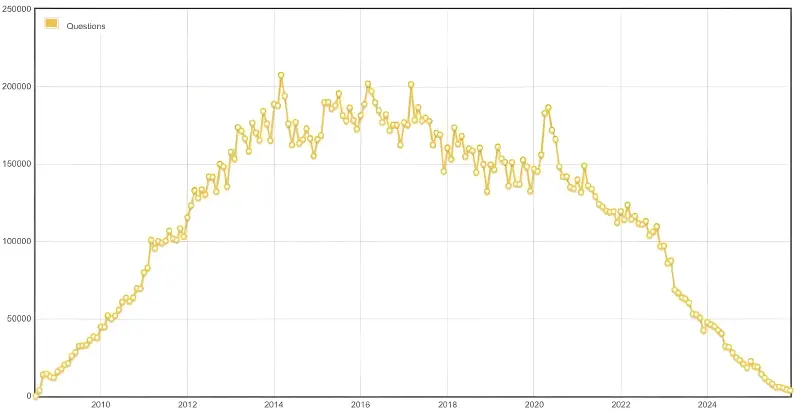

Una señal interesante en esa dirección es Stack Overflow. El volumen de nuevas preguntas ha estado claramente bajo presión desde el boom de la IA, mientras la empresa ha posicionado su base de conocimiento y su data licensing de forma más agresiva como producto. Eso todavía no prueba un nuevo modelo universal, pero sí apunta a una dirección: el valor podría venir cada vez más no solo de las pageviews, sino del acceso estructurado y licenciado al conocimiento.

FAQ

¿WebMCP ya es un estándar web oficial?

¿WebMCP es lo mismo que MCP?

¿Esto significa el fin del SEO?

¿Hay que reconstruir ahora mismo los sitios web para agentes de IA?

¿Por qué aumenta tanto el tráfico de bots cuando intervienen agentes?

Conclusión

Si hoy gestionas un sitio web, no hay motivo para entrar en pánico y reconstruirlo todo alrededor de WebMCP mañana. Pero sí deberías empezar a revisar ya si tu contenido es estructurado, rápido, legible por máquina y accesible de forma limpia.

Eso es lo que determinará si, en un futuro agentivo, tu sitio solo se ve bien o si realmente resulta utilizable para los sistemas que importan.

Cheers, Joe

Fuentes y enlaces útiles

- TechCrunch: Cloudflare CEO says online bot traffic will exceed human traffic by 2027

- Chrome for Developers: WebMCP Early Preview Program

- Chrome for Developers: When to use WebMCP and MCP

- WebMCP Draft

- Alphabet: Q4 2025 Earnings Release

- Meta: Q4 2025 Results

- Stack Overflow Data Licensing

- Prosus HY2026 Summary Consolidated Financial Statements

Hasta la próxima,

Joe