WebMCP dijelaskan: agen AI sedang mengubah web

Daftar isi

Pada Maret 2026, CEO Cloudflare Matthew Prince mengatakan di SXSW bahwa traffic bot bisa melampaui traffic manusia pada 2027. Logika di balik pernyataan itu cukup jelas: satu orang membuka beberapa tab. Satu agent dapat mengirim ratusan atau ribuan request paralel untuk tugas yang sama, membandingkan sumber, dan menyiapkan aksi.

Bagi banyak operator, bot selama ini terutama dianggap sebagai masalah keamanan: scraper, spam, dan serangan DDoS . Dengan browser agent dan workflow AI, kini muncul kategori kedua: bot yang bukan mencoba merusak, melainkan membaca, mengevaluasi, dan bertindak atas nama Anda.

Di titik itulah WebMCP menjadi menarik. Bukan sebagai standar web baru yang sudah final, melainkan sebagai konsep awal tentang bagaimana website dan agent di dalam browser bisa berinteraksi dengan cara yang lebih terstruktur.

Apa itu WebMCP?

WebMCP adalah pendekatan awal yang memungkinkan website mengekspos kapabilitas eksplisit dan context kepada agent di browser. Alih-alih memaksa agent menebak-nebak dari HTML dan susah payah menafsirkan tombol atau form lewat DOM scraping, sebuah website dapat menjelaskan dengan lebih jelas tindakan apa yang tersedia.

Gagasan intinya sederhana:

- Website mengekspos kapabilitas terstruktur, bukan hanya antarmuka visual.

- Agent dapat menggunakan kapabilitas itu dengan lebih presisi di dalam context browser.

- Pengguna tetap berada dalam alur tab, alih-alih mengklik setiap langkah secara manual.

Catatan pentingnya adalah ini: per April 2026, WebMCP belum menjadi standar W3C yang diratifikasi dan belum menjadi fitur browser yang tersedia luas. Ini masih berupa arah awal dalam bentuk draft atau preview yang sedang dibahas dan diuji secara publik oleh Chrome.

Apa perbedaan antara MCP dan WebMCP?

Di sinilah banyak diskusi mulai menjadi kurang presisi. WebMCP bukan sekadar “MCP untuk website”, dan juga bukan penerus langsung MCP.

- MCP secara umum menjelaskan bagaimana model dan client dapat berbicara dengan tools, sumber data, dan layanan.

- WebMCP menangani kasus spesifik ketika sebuah agent berinteraksi dengan website di dalam browser.

- MCP dan WebMCP berarti menyelesaikan masalah yang berhubungan, tetapi tidak sama.

Perbedaan ini penting. Kalau tidak, orang bisa dengan mudah mengira bahwa seluruh web terbuka akan segera berpindah ke satu standar baru secara menyeluruh. Kita belum sampai ke sana.

Mengapa traffic bot bisa naik tajam pada 2027?

Poin utamanya adalah fan-out effect yang dijelaskan Prince. Jika hari ini Anda sedang mencari laptop, mungkin Anda membuka 5 sampai 10 halaman. Satu agent bisa memecah tugas yang sama menjadi pekerjaan paralel:

- Memeriksa banyak retailer sekaligus.

- Membandingkan waktu pengiriman, harga, kebijakan retur, dan garansi.

- Menyaring duplikasi, iklan, dan hasil yang tidak relevan.

- Mengembalikan ringkasan keputusan, bukan kebisingan hasil browsing.

Jumlah request yang tepat tentu tergantung pada tugasnya. Tetapi arahnya jelas: agent melipatgandakan jumlah query per pengguna, karena mereka bekerja paralel dan mengotomatisasi lebih banyak langkah perantara daripada manusia.

Pergeseran pribadi saya: dari mencari menjadi mendelegasikan

Saya sendiri sudah sangat merasakan pergeseran ini. Dulu melakukan riset berarti mengetik query, membuka tiga sampai sepuluh tab, membuang konten sampah, memperbaiki query, lalu mengulang lagi. Sekarang saya mendelegasikan banyak bagian dari pekerjaan itu.

Contoh konkret dari workflow saya sehari-hari: ketika saya memantau hardware baru, update keamanan, atau perubahan pada tools, saya tidak hanya melakukan pencarian sekali lalu selesai. Saya punya agent yang mengecek topik-topik itu berulang kali, memfilter, lalu memprioritaskannya. Temuan kritis langsung masuk ke ponsel saya sebagai push alert. Yang kurang mendesak masuk ke dashboard atau reading list untuk nanti.

Perbedaannya bukan cuma soal kenyamanan. Perbedaan sesungguhnya adalah bahwa setup seperti ini menghasilkan traffic secara terus-menerus, bahkan ketika saya tidak sedang aktif browsing. Itu saja sudah cukup menjelaskan mengapa traffic bot bisa tumbuh jauh lebih cepat, secara statistik, dibanding sesi manusia.

Apa artinya untuk website dan SEO?

Saya tidak berpikir SEO klasik sudah “mati”. Tetapi saya memang melihat kemungkinan besar bahwa SEO akan dilengkapi oleh lapisan baru. Tidak cukup lagi jika search engine saja yang memahami konten Anda. Agent juga akan semakin perlu mengekstrak, membandingkan, dan memasukkan konten itu ke dalam context mereka sendiri.

Untuk lapisan berikutnya ini, ada empat hal yang paling penting:

- Struktur yang rapi: heading, tabel, form, dan HTML semantik harus jelas dan tidak ambigu.

- Data yang machine-readable: Schema.org, metadata yang konsisten, dan nama field yang jelas lebih membantu daripada marketing copy yang terlalu berbunga-bunga.

- Flow yang mudah diakses: jika informasi atau aksi penting tersembunyi di balik konstruksi JavaScript yang rapuh, agent akan melambat tanpa perlu.

- Latency dan reliability: situs yang merespons cepat, stabil, dan dapat diprediksi akan memiliki keunggulan teknis.

Istilah AEO (Agent Engine Optimization) akan semakin sering muncul dalam konteks ini. Saya tidak melihatnya sebagai pengganti SEO, melainkan sebagai disiplin visibilitas tambahan untuk sistem agentic.

Apa yang sebaiknya dilakukan operator sekarang

Jika hari ini Anda menjalankan website, portal, atau aplikasi, saya tidak akan memulai dari hype. Saya akan memulai dari hygiene:

- Perluas structured data. Tinjau di mana

Schema.orgsudah masuk akal: artikel, produk, FAQ, data organisasi, breadcrumb. - Buat konten penting bisa diakses tanpa friksi yang tidak perlu. Harga, ketersediaan, spesifikasi, jalur kontak, dan fungsi inti tidak seharusnya tersembunyi di balik trik UI yang rapuh.

- Sederhanakan form dan interaction flow. Label yang jelas, tombol yang stabil, state yang dapat diprediksi, dan HTML yang bersih membantu manusia maupun agent.

- Ukur performa dengan disiplin. Respons yang lambat, redirect yang tidak perlu, dan frontend yang tidak stabil mengurangi visibilitas dan usability.

- Pisahkan traffic bot dengan benar. Tidak semua bot itu jahat, tetapi tidak semua bot juga bernilai. Monitoring, rate limits, dan kebijakan yang jelas akan semakin penting.

- Tawarkan akses terstruktur jika memang masuk akal secara bisnis. Itu bisa berupa API, feed, metadata yang rapi, atau nanti browser flow yang lebih ramah agent.

Siapa yang membayar internet jika agent yang melakukan klik?

Pertanyaan ekonominya setidaknya sama menariknya dengan pertanyaan teknisnya. Alphabet melaporkan US$82,3 miliar pendapatan iklan pada Q4 2025, sementara Meta melaporkan sekitar US$58,1 miliar pada periode yang sama. Angka-angka itu menunjukkan satu hal dengan sangat jelas: web saat ini masih sangat bergantung pada perhatian, klik, dan inventaris iklan.

Jika pengguna semakin sering mengonsumsi jawaban melalui agent alih-alih mengunjungi halaman secara langsung, model saat ini akan berada di bawah tekanan. Ini tidak otomatis berarti iklan akan hilang. Namun ini menunjukkan bahwa akses langsung, data licensing, API, dan model berlangganan bisa menjadi lebih penting.

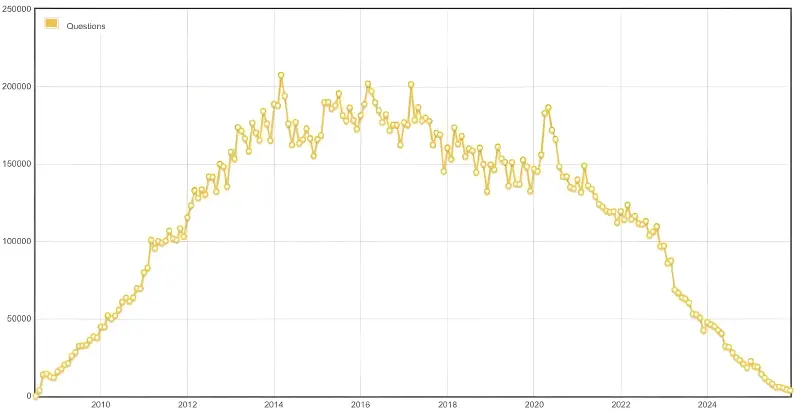

Salah satu sinyal menarik ke arah itu datang dari Stack Overflow. Volume pertanyaan baru terlihat berada di bawah tekanan sejak boom AI, sementara perusahaan tersebut semakin agresif memosisikan knowledge base dan data licensing mereka sebagai produk. Ini belum membuktikan model universal baru, tetapi menunjukkan satu arah: nilai di masa depan mungkin semakin datang bukan hanya dari pageviews, tetapi juga dari akses terstruktur dan berlisensi ke pengetahuan.

FAQ

Apakah WebMCP sudah menjadi standar web resmi?

Apakah WebMCP sama dengan MCP?

Apakah ini berarti SEO sudah berakhir?

Apakah website harus segera dibangun ulang untuk agent AI?

Mengapa traffic bot meningkat begitu besar ketika agent terlibat?

Kesimpulan

Jika Anda menjalankan website hari ini, tidak ada alasan untuk panik dan membangun ulang semuanya di sekitar WebMCP besok. Tetapi Anda sebaiknya mulai memeriksa sekarang apakah konten Anda terstruktur, cepat, machine-readable, dan mudah diakses dengan rapi.

Itulah yang akan menentukan apakah, di masa depan yang agentic, situs Anda hanya terlihat bagus atau benar-benar bisa digunakan oleh sistem yang akan menjadi penting.

Cheers, Joe

Sumber dan bacaan lanjutan

- TechCrunch: Cloudflare CEO says online bot traffic will exceed human traffic by 2027

- Chrome for Developers: WebMCP Early Preview Program

- Chrome for Developers: When to use WebMCP and MCP

- WebMCP Draft

- Alphabet: Q4 2025 Earnings Release

- Meta: Q4 2025 Results

- Stack Overflow Data Licensing

- Prosus HY2026 Summary Consolidated Financial Statements

Sampai jumpa di tulisan berikutnya,

Joe