WebMCP spiegato: gli agenti AI stanno cambiando il web

Indice dei contenuti

Nel marzo 2026, il CEO di Cloudflare Matthew Prince ha detto al SXSW che il traffico bot potrebbe superare il traffico umano entro il 2027. La logica dietro questa affermazione è facile da capire: una persona apre qualche tab. Un agente può generare centinaia o migliaia di richieste in parallelo per la stessa attività, confrontare fonti e preparare azioni.

Per molti operatori, i bot erano soprattutto un problema di sicurezza: scraper, spam e attacchi DDoS . Con i browser agent e i workflow basati su AI, sta emergendo una seconda categoria: bot che non cercano di rompere qualcosa, ma di leggere, valutare e agire per tuo conto.

È proprio qui che WebMCP diventa interessante. Non come un nuovo standard web già definito, ma come un concetto ancora iniziale su come i siti web e gli agenti nel browser potrebbero interagire in modo più strutturato.

Che cos’è WebMCP?

WebMCP è un approccio ancora iniziale che consente ai siti web di esporre capacità esplicite e contesto a un agente nel browser. Invece di costringere un agente a intuire tutto dall’HTML e a interpretare faticosamente pulsanti o form tramite DOM scraping, un sito può descrivere con maggiore chiarezza quali azioni sono disponibili.

L’idea di base è semplice:

- Un sito web espone capacità strutturate invece di limitarsi a un’interfaccia visiva.

- Un agente può usare queste capacità con maggiore precisione nel contesto del browser.

- L’utente rimane nel flusso della tab invece di cliccare manualmente ogni singolo passaggio.

La precisazione importante è questa: ad aprile 2026, WebMCP non è uno standard W3C ratificato né una funzionalità browser ampiamente disponibile. È una direzione ancora allo stadio di draft o preview, che Chrome sta discutendo e sperimentando pubblicamente.

Qual è la differenza tra MCP e WebMCP?

È qui che molte discussioni diventano imprecise. WebMCP non è semplicemente “MCP per i siti web”, e non è nemmeno il successore diretto di MCP.

- MCP descrive, in termini generali, come modelli e client possono parlare con strumenti, fonti dati e servizi.

- WebMCP riguarda il caso specifico in cui un agente interagisce con un sito web all’interno del browser.

- MCP e WebMCP quindi risolvono problemi collegati, ma diversi.

Questa distinzione conta. Altrimenti si rischia facilmente di dare l’impressione che l’intero web aperto stia per migrare in blocco verso un unico nuovo standard. Non siamo a quel punto.

Perché il traffico bot potrebbe crescere molto entro il 2027?

Il punto chiave è il fan-out effect descritto da Prince. Se oggi stai cercando un laptop, potresti aprire 5 o 10 pagine. Un agente può dividere la stessa attività in lavoro parallelo:

- Controlla più rivenditori contemporaneamente.

- Confronta tempi di spedizione, prezzi, politiche di reso e garanzie.

- Filtra duplicati, pubblicità e risultati irrilevanti.

- Ti restituisce una sintesi decisionale invece del rumore della navigazione.

Il numero esatto di richieste dipende dal compito. Ma la direzione è chiara: gli agenti moltiplicano il numero di query per utente, perché lavorano in parallelo e automatizzano più passaggi intermedi di quanto faccia un essere umano.

Il mio cambiamento personale: dalla ricerca alla delega

Io questo cambiamento lo sento già nel mio workflow quotidiano. Prima fare ricerca significava spesso digitare una query, aprire da tre a dieci tab, scartare contenuti inutili, affinare la ricerca e ricominciare. Oggi delego buona parte di quel lavoro.

Un esempio concreto della mia routine: quando monitoro nuovo hardware, aggiornamenti di sicurezza o cambiamenti nei tool, non faccio solo ricerche una tantum. Ho agenti che ricontrollano questi temi, li filtrano e li prioritizzano. Le cose critiche mi arrivano subito sul telefono come push notification. Gli elementi meno urgenti finiscono in una dashboard o in una reading list da riprendere più tardi.

La differenza non è solo comodità. La vera differenza è che configurazioni del genere generano traffico in modo continuo, anche quando io non sto navigando attivamente. Già questo aiuta a capire perché il traffico bot possa crescere molto più velocemente, in termini statistici, rispetto alle sessioni umane.

Cosa significa per i siti web e per la SEO?

Non credo che la SEO classica sia “morta”. Però credo sia molto probabile che venga affiancata da altro. Non basta più che i motori di ricerca capiscano i tuoi contenuti. Sempre più spesso anche gli agenti dovranno estrarli, confrontarli e integrarli nel proprio contesto.

Per questo nuovo livello contano soprattutto quattro cose:

- Struttura pulita: heading, tabelle, form e HTML semantico devono essere inequivocabili.

- Dati machine-readable: Schema.org, metadati coerenti e campi chiaramente nominati aiutano più di un copy di marketing troppo ornamentale.

- Flussi accessibili: se informazioni o azioni importanti sono nascoste dietro costrutti JavaScript fragili, gli agenti vengono rallentati inutilmente.

- Latenza e affidabilità: i siti che rispondono in fretta, in modo stabile e prevedibile, avranno un vantaggio tecnico.

In questo contesto sentirai parlare sempre più spesso di AEO (Agent Engine Optimization). Io non lo vedrei come un sostituto della SEO, ma come una disciplina di visibilità aggiuntiva per i sistemi agentici.

Cosa dovrebbero fare ora gli operatori

Se oggi gestisci un sito web, un portale o un’applicazione, io non partirei dall’hype. Partirei dall’igiene:

- Espandere i dati strutturati. Verifica dove

Schema.orgha già senso: articoli, prodotti, FAQ, organization data, breadcrumbs. - Rendere raggiungibili i contenuti importanti senza attriti inutili. Prezzi, disponibilità, specifiche, canali di contatto e funzionalità core non dovrebbero essere nascosti dietro trucchi UI fragili.

- Semplificare form e interaction flow. Label chiare, pulsanti stabili, stati prevedibili e HTML pulito aiutano sia le persone sia gli agenti.

- Misurare le performance con rigore. Tempi di risposta lenti, redirect inutili e frontend instabili riducono visibilità e usabilità.

- Separare bene il traffico bot. Non tutti i bot sono malevoli, ma non tutti portano valore. Monitoring, rate limits e policy chiare conteranno sempre di più.

- Offrire accesso strutturato dove ha senso dal punto di vista business. Può voler dire un’API, un feed, metadata puliti o, in futuro, un browser flow più agent-friendly.

Chi paga internet se sono gli agenti a cliccare?

La domanda economica è interessante almeno quanto quella tecnica. Alphabet ha riportato 82,3 miliardi di dollari di ricavi pubblicitari nel Q4 2025, mentre Meta ha riportato circa 58,1 miliardi nello stesso periodo. Questi numeri mostrano una cosa molto chiaramente: il web di oggi è ancora profondamente legato ad attenzione, clic e inventory pubblicitaria.

Se gli utenti consumano sempre più risposte tramite agenti invece di visitare direttamente le pagine, questo mette sotto pressione il modello attuale. Non significa automaticamente che la pubblicità sparirà. Ma suggerisce che accesso diretto, data licensing, API e modelli in abbonamento potrebbero diventare più importanti.

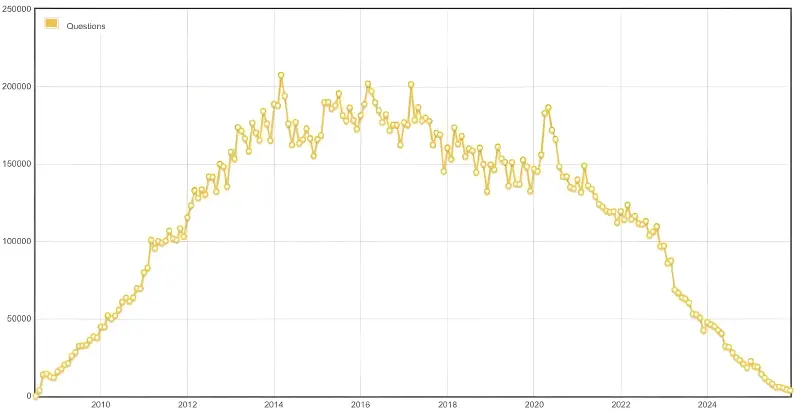

Un segnale interessante in questa direzione arriva da Stack Overflow. Il volume delle nuove domande è visibilmente sotto pressione dall’esplosione dell’AI, mentre l’azienda ha iniziato a posizionare in modo più aggressivo la propria knowledge base e la data licensing come prodotto. Questo non prova ancora un nuovo modello universale, ma indica una direzione: il valore potrebbe arrivare sempre di più non solo dalle pageview, ma anche da un accesso strutturato e licenziato alla conoscenza.

FAQ

WebMCP è già uno standard web ufficiale?

WebMCP è la stessa cosa di MCP?

Questo significa la fine della SEO?

Bisogna ricostruire subito i siti web per gli agenti AI?

Perché il traffico bot aumenta così tanto quando entrano in gioco gli agenti?

Conclusione

Se oggi gestisci un sito web, non c’è motivo di andare nel panico e ricostruire tutto attorno a WebMCP domani. Però dovresti iniziare già adesso a verificare se i tuoi contenuti sono strutturati, veloci, machine-readable e accessibili in modo pulito.

È questo che determinerà se, in un futuro agentico, il tuo sito sarà solo bello da vedere oppure davvero utilizzabile dai sistemi che conteranno.

Cheers, Joe

Fonti e link utili

- TechCrunch: Cloudflare CEO says online bot traffic will exceed human traffic by 2027

- Chrome for Developers: WebMCP Early Preview Program

- Chrome for Developers: When to use WebMCP and MCP

- WebMCP Draft

- Alphabet: Q4 2025 Earnings Release

- Meta: Q4 2025 Results

- Stack Overflow Data Licensing

- Prosus HY2026 Summary Consolidated Financial Statements

Alla prossima,

Joe