WebMCP解説: AIエージェントはWebをどう変えるのか

目次

2026年3月、CloudflareのCEOであるMatthew PrinceはSXSWで、2027年までにボットトラフィックが人間のトラフィックを上回る可能性があると述べました。理屈はわかりやすいです。人間は数個のタブを開きます。一方でエージェントは、同じタスクに対して並列に何百、何千ものリクエストを投げ、情報源を比較し、次のアクションを準備できます。

多くの運用者にとって、これまでボットは主にセキュリティの問題でした。スクレイパーやスパム、そして DDoS攻撃 です。しかし、ブラウザエージェントとAIワークフローの広がりによって、別の種類のボットが現れています。壊すためではなく、読み取り、評価し、あなたの代わりに行動するボットです。

そこで重要になってくるのが WebMCP です。完成済みの新しいWeb標準としてではなく、Webサイトとブラウザ内エージェントが、より構造化された形でやり取りするための初期コンセプトとして注目すべきものです。

WebMCPとは何か?

WebMCPは、Webサイトがブラウザ内のエージェントに対して 明示的な機能とコンテキスト を公開できるようにする初期段階のアプローチです。エージェントがHTMLから推測し、DOMスクレイピングでボタンやフォームを苦労して解釈するのではなく、サイト側が利用可能な操作をもっと明確に示せるようになります。

考え方の核はシンプルです。

- Webサイトは、単なる見た目のUIではなく、構造化された機能を公開する。

- エージェントは、その機能をブラウザコンテキストの中でより正確に利用できる。

- ユーザーはタブの流れの中に留まったまま、すべての手順を手動でクリックしなくてよくなる。

ここで重要なのは位置づけです。2026年4月時点で、WebMCPはW3Cに正式採択された標準ではなく、広く使えるブラウザ機能でもありません。 まだドラフト/プレビュー段階の方向性であり、Chromeが公開の場で議論し、実験しているものです。

MCPとWebMCPの違いは何か?

ここは議論が雑になりやすいポイントです。WebMCPは単なる「Webサイト向けMCP」ではありませんし、MCPの直接の後継でもありません。

- MCP は、モデルとクライアントがツール、データソース、サービスとどうやり取りするかを一般的に説明するものです。

- WebMCP は、エージェントが ブラウザ内で Webサイトとやり取りするケースに焦点を当てています。

- つまりMCPとWebMCPは関連はしていても、解いている問題は別です。

この違いは重要です。そうでないと、オープンWeb全体がすぐに単一の新標準へ一気に移行するかのような誤解が生まれます。現実はまだそこまで進んでいません。

なぜ2027年までにボットトラフィックが大きく増えるのか?

核心にあるのは、Princeが説明した ファンアウト効果 です。いまノートPCを探すとき、普通は5〜10ページほど開くでしょう。ですがエージェントは、同じ作業を並列の仕事に分解できます。

- 複数の販売サイトを同時に確認する。

- 配送時間、価格、返品ポリシー、保証内容を比較する。

- 重複、広告、無関係な結果を取り除く。

- 生の検索ノイズではなく、意思決定に使える要約を返す。

実際に何件のリクエストになるかはタスク次第です。ただ、方向性は明確です。エージェントはユーザー1人あたりの問い合わせ量を増幅する のです。並列処理ができ、人間より多くの中間ステップを自動化できるからです。

個人的な変化: 検索から委任へ

僕自身、この変化をかなりはっきり感じています。以前のリサーチは、検索語を入れて、3〜10個のタブを開き、ノイズだらけのコンテンツを捨て、検索語を練り直し、またやり直すという流れでした。今は、そのかなりの部分を委任しています。

日常の具体例を挙げると、新しいハードウェア、セキュリティ更新、ツールの変更を追うとき、僕は単発の検索で終わりません。エージェントにそれらのトピックを継続的にチェックさせ、フィルタし、優先順位を付けさせています。重要なものはそのままスマホにプッシュ通知で届きます。急ぎでないものはダッシュボードや後で読むためのリストに回ります。

違いは単なる利便性ではありません。こうしたセットアップは、僕が能動的にブラウズしていないときでも 継続的にトラフィックを発生させる という点が重要です。それだけでも、なぜボットトラフィックが人間のセッションよりはるかに速く増えうるのかがわかります。

WebサイトとSEOにとって何を意味するのか?

僕は、従来のSEOが「終わった」とは思っていません。ただ、それが 補完されていく 可能性はかなり高いと見ています。検索エンジンだけがコンテンツを理解すればいい時代ではありません。これからはエージェントもコンテンツを抽出し、比較し、自分の文脈に組み込む必要が出てきます。

この次のレイヤーで特に重要なのは4つです。

- 明確な構造: 見出し、表、フォーム、セマンティックHTMLが曖昧でないこと。

- 機械可読なデータ: Schema.org、一貫したメタデータ、意味の明確なフィールド名は、飾ったマーケティング文よりずっと重要です。

- 扱いやすい導線: 重要な情報や操作が脆いJavaScriptの裏に隠れていると、エージェントは無駄に足止めされます。

- レイテンシと信頼性: 高速で安定し、予測可能に応答するサイトは技術的に有利です。

この文脈では AEO (Agent Engine Optimization) という言葉も今後よく聞くはずです。僕はこれをSEOの置き換えではなく、エージェント時代の追加的な可視性領域として捉えています。

いま運営側がやるべきこと

もし今、Webサイト、ポータル、アプリを運営しているなら、僕は話題性から始めません。まず基本整備から始めます。

- 構造化データを広げる。

Schema.orgがすでに有効な場所を見直します。記事、商品、FAQ、組織情報、パンくずリストなどです。 - 重要な情報に無駄なくたどり着けるようにする。 価格、在庫、仕様、問い合わせ経路、主要機能が脆いUIの裏に隠れていてはいけません。

- フォームと導線を簡潔にする。 明確なラベル、安定したボタン、予測可能な状態、クリーンなHTMLは、人にもエージェントにも効きます。

- パフォーマンスを厳密に測る。 応答の遅さ、不要なリダイレクト、不安定なフロントエンドは可視性と使いやすさの両方を落とします。

- ボットトラフィックを正しく見分ける。 すべてのボットが悪意あるわけではありませんが、すべてのボットが価値を持つわけでもありません。監視、レート制限、明確な方針がより重要になります。

- ビジネス上意味がある場所では構造化されたアクセス手段を用意する。 API、フィード、きれいなメタデータ、あるいは将来的にはよりエージェント向けに扱いやすいブラウザ導線がそれに当たります。

クリックをエージェントが担うなら、インターネットの収益はどうなるのか?

経済面の問いは、技術面と同じくらい興味深いです。Alphabetは2025年Q4の広告収益として 823億ドル を、Metaは同期間に約 581億ドル を報告しました。この数字が示すのはシンプルです。いまのWebは、依然として注目、クリック、広告在庫に深く依存しています。

ユーザーが自分でページを訪れず、エージェント経由で答えを消費することが増えれば、今のモデルには圧力がかかります。もちろん、広告が即座に消えるという意味ではありません。ただ、直接アクセス、データライセンス、API、サブスクリプション型モデル の重要性が増すことは十分ありえます。

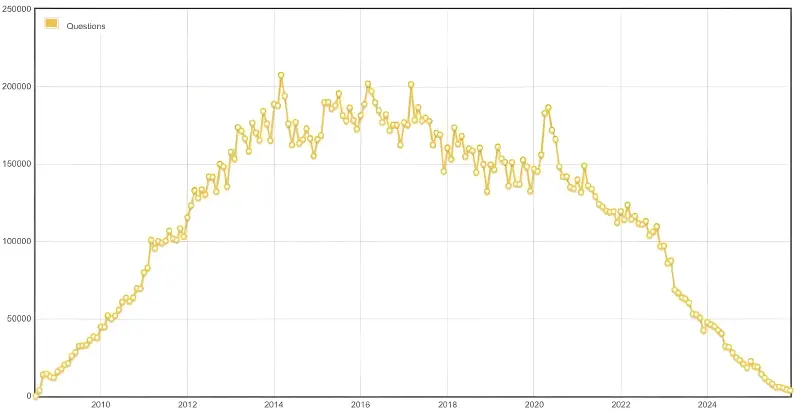

その方向を示す興味深いシグナルの1つが Stack Overflow です。AIブーム以降、新規質問の量は目に見えて圧力を受けている一方で、同社はナレッジベースとデータライセンスを、より明確にプロダクトとして打ち出しています。これだけで新しい普遍的モデルが証明されたわけではありませんが、方向性は見えます。価値は今後、ページビューだけでなく、ライセンスされた構造化された知識へのアクセス からも生まれるようになるかもしれません。

FAQ

WebMCPはすでに公式なWeb標準ですか?

WebMCPはMCPと同じものですか?

これはSEOの終わりを意味しますか?

Webサイトを今すぐAIエージェント向けに作り直す必要がありますか?

なぜエージェントが入るとボットトラフィックが大きく増えるのですか?

まとめ

いまWebサイトを運営しているとしても、明日すべてをWebMCP中心に作り直す必要はありません。ただし、今のうちに、自分のコンテンツが 構造化され、十分に速く、機械可読で、きちんとアクセスできる状態か を確認し始めるべきです。

それが、エージェント時代において、あなたのサイトが「見た目が良いだけ」なのか、それとも本当に重要なシステムに使われるサイトなのかを分けます。

Cheers, Joe

参考リンク

- TechCrunch: Cloudflare CEO says online bot traffic will exceed human traffic by 2027

- Chrome for Developers: WebMCP Early Preview Program

- Chrome for Developers: When to use WebMCP and MCP

- WebMCP Draft

- Alphabet: Q4 2025 Earnings Release

- Meta: Q4 2025 Results

- Stack Overflow Data Licensing

- Prosus HY2026 Summary Consolidated Financial Statements

また次回、

Joe