WebMCP dijelaskan: ejen AI sedang mengubah web

Jadual kandungan

Pada Mac 2026, CEO Cloudflare Matthew Prince berkata di SXSW bahawa trafik bot boleh melebihi trafik manusia menjelang 2027. Logik di sebalik kenyataan itu mudah difahami: seorang manusia membuka beberapa tab. Seorang ejen pula boleh menghantar ratusan atau ribuan permintaan secara selari untuk tugasan yang sama, membandingkan sumber, dan menyediakan tindakan.

Bagi ramai operator, bot selama ini dilihat terutamanya sebagai isu keselamatan: scraper, spam, dan serangan DDoS . Dengan kemunculan browser agent dan workflow AI, kini muncul kategori kedua: bot yang tidak cuba memecahkan apa-apa, tetapi membaca, menilai, dan bertindak bagi pihak anda.

Di sinilah WebMCP menjadi menarik. Bukan sebagai standard web baharu yang sudah siap, tetapi sebagai konsep awal tentang bagaimana laman web dan ejen dalam pelayar boleh berinteraksi dengan cara yang lebih berstruktur.

Apakah itu WebMCP?

WebMCP ialah pendekatan awal yang membolehkan laman web mendedahkan keupayaan eksplisit dan context kepada ejen dalam pelayar. Daripada memaksa ejen meneka berdasarkan HTML dan mentafsir butang atau borang secara susah payah melalui DOM scraping, laman web boleh menerangkan dengan lebih jelas tindakan yang tersedia.

Idea terasnya ringkas:

- Laman web mendedahkan keupayaan berstruktur, bukan sekadar antaramuka visual.

- Ejen boleh menggunakan keupayaan itu dengan lebih tepat dalam context pelayar.

- Pengguna kekal dalam aliran tab, bukannya perlu klik setiap langkah secara manual.

Perkara penting di sini ialah penjelasan konteksnya: setakat April 2026, WebMCP belum menjadi standard W3C yang diratifikasi dan belum menjadi ciri pelayar yang tersedia secara meluas. Ia masih merupakan arah awal dalam bentuk draft atau preview yang sedang dibincangkan dan diuji secara terbuka oleh Chrome.

Apakah perbezaan antara MCP dan WebMCP?

Di sinilah banyak perbincangan menjadi kurang tepat. WebMCP bukan sekadar “MCP untuk laman web”, dan juga bukan pengganti langsung kepada MCP.

- MCP menerangkan secara umum bagaimana model dan client boleh berhubung dengan tools, sumber data, dan services.

- WebMCP menangani kes khusus apabila ejen berinteraksi dengan laman web di dalam pelayar.

- MCP dan WebMCP menyelesaikan masalah yang berkait, tetapi berbeza.

Perbezaan ini penting. Jika tidak, orang mudah mendapat gambaran bahawa seluruh web terbuka akan segera beralih kepada satu standard baharu secara menyeluruh. Kita masih belum sampai ke tahap itu.

Mengapa trafik bot boleh meningkat dengan ketara menjelang 2027?

Poin utamanya ialah fan-out effect yang diterangkan oleh Prince. Jika hari ini anda sedang mencari laptop, anda mungkin membuka 5 hingga 10 halaman. Seorang ejen boleh memecahkan tugasan yang sama kepada kerja selari:

- Menyemak beberapa peruncit serentak.

- Membandingkan masa penghantaran, harga, polisi pemulangan, dan jaminan.

- Menapis pendua, iklan, dan hasil yang tidak relevan.

- Mengembalikan ringkasan keputusan, bukan bunyi bising daripada browsing.

Bilangan tepat permintaan bergantung pada tugasan. Tetapi arahnya jelas: ejen melipatgandakan jumlah query bagi setiap pengguna, kerana mereka bekerja secara selari dan mengautomasi lebih banyak langkah pertengahan berbanding manusia.

Perubahan peribadi saya: daripada mencari kepada mendelegasikan

Saya sendiri sudah merasai perubahan ini dengan jelas dalam workflow harian. Dulu, membuat research bermaksud menaip query, membuka tiga hingga sepuluh tab, membuang kandungan yang tidak berguna, memperhalus carian, dan mengulang semula. Hari ini, saya mendelegasikan banyak bahagian kerja itu.

Contoh yang jelas daripada rutin saya: apabila saya memantau hardware baharu, update keselamatan, atau perubahan pada tools, saya bukan sekadar melakukan carian sekali lalu selesai. Saya ada ejen yang menyemak semula topik-topik ini, menapisnya, dan memprioritikan hasilnya. Perkara yang kritikal terus masuk ke telefon saya sebagai push alert. Yang kurang mendesak dimasukkan ke dashboard atau reading list untuk dibaca kemudian.

Perbezaannya bukan sekadar kemudahan. Perbezaan sebenarnya ialah setup seperti ini menjana trafik secara berterusan, walaupun saya tidak sedang aktif browsing. Itu sahaja sudah cukup untuk menjelaskan mengapa trafik bot boleh berkembang jauh lebih cepat, secara statistik, berbanding sesi manusia.

Apa maksudnya untuk laman web dan SEO?

Saya tidak fikir SEO klasik sudah “mati”. Tetapi saya memang melihat kemungkinan besar bahawa ia akan dilengkapi oleh lapisan baharu. Tidak lagi memadai jika hanya search engine memahami kandungan anda. Semakin kerap, ejen juga perlu mengekstrak, membandingkan, dan memasukkan kandungan itu ke dalam context mereka sendiri.

Untuk lapisan seterusnya ini, empat perkara paling penting:

- Struktur yang bersih: heading, jadual, borang, dan HTML semantik mesti jelas dan tidak mengelirukan.

- Data yang machine-readable: Schema.org, metadata yang konsisten, dan field yang dinamakan dengan jelas membantu lebih banyak daripada copy pemasaran yang terlalu berbunga.

- Flow yang mudah diakses: jika maklumat atau tindakan penting tersembunyi di sebalik binaan JavaScript yang rapuh, ejen akan diperlahankan tanpa sebab.

- Latency dan reliability: laman yang memberi respons pantas, stabil, dan boleh diramal akan mendapat kelebihan teknikal.

Istilah AEO (Agent Engine Optimization) akan semakin kerap muncul dalam konteks ini. Saya tidak melihatnya sebagai pengganti SEO, tetapi sebagai disiplin keterlihatan tambahan untuk sistem agentic.

Apa yang patut operator lakukan sekarang

Jika anda mengendalikan laman web, portal, atau aplikasi hari ini, saya tidak akan bermula dengan hype. Saya akan bermula dengan hygiene:

- Luaskan structured data. Semak di mana

Schema.orgsudah sesuai digunakan: artikel, produk, FAQ, data organisasi, breadcrumb. - Jadikan kandungan penting boleh dicapai tanpa friction yang tidak perlu. Harga, ketersediaan, spesifikasi, laluan hubungan, dan fungsi utama tidak sepatutnya disembunyikan di sebalik helah UI yang rapuh.

- Permudahkan borang dan interaction flow. Label yang jelas, butang yang stabil, state yang boleh diramal, dan HTML yang bersih membantu manusia dan ejen.

- Ukur prestasi dengan disiplin. Masa respons yang perlahan, redirect yang tidak perlu, dan frontend yang tidak stabil mengurangkan keterlihatan dan kebolehgunaan.

- Pisahkan trafik bot dengan betul. Bukan semua bot itu berniat jahat, tetapi bukan semua bot juga membawa nilai. Monitoring, rate limits, dan polisi yang jelas akan menjadi semakin penting.

- Sediakan akses berstruktur apabila ia masuk akal dari sudut perniagaan. Ini boleh bermaksud API, feed, metadata yang bersih, atau nanti browser flow yang lebih mesra ejen.

Siapa yang akan membayar internet jika ejen yang melakukan klik?

Soalan ekonominya sekurang-kurangnya sama menarik dengan soalan teknikalnya. Alphabet melaporkan AS$82.3 bilion dalam hasil pengiklanan pada Q4 2025, manakala Meta melaporkan sekitar AS$58.1 bilion dalam tempoh yang sama. Angka-angka ini menunjukkan satu perkara dengan sangat jelas: web hari ini masih sangat bergantung pada perhatian, klik, dan inventori iklan.

Jika pengguna semakin kerap mendapatkan jawapan melalui ejen berbanding melawat halaman sendiri, model semasa akan berada di bawah tekanan. Ini tidak semestinya bermakna pengiklanan akan hilang. Tetapi ia menunjukkan bahawa akses langsung, data licensing, API, dan model langganan boleh menjadi lebih penting.

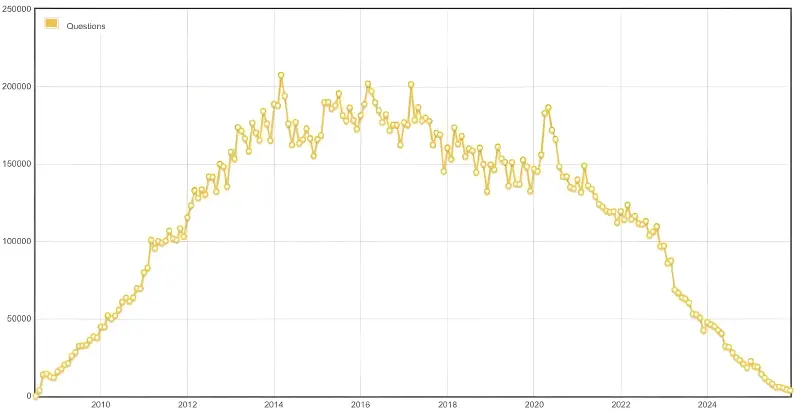

Satu isyarat yang menarik ke arah itu datang daripada Stack Overflow. Jumlah soalan baharu jelas berada di bawah tekanan sejak ledakan AI, sementara syarikat itu semakin agresif meletakkan knowledge base dan data licensing mereka sebagai produk. Itu belum membuktikan model baharu yang universal, tetapi ia menunjukkan arah: nilai pada masa hadapan mungkin datang bukan sahaja daripada pageviews, tetapi juga daripada akses berstruktur dan berlesen kepada pengetahuan.

FAQ

Adakah WebMCP sudah menjadi standard web rasmi?

Adakah WebMCP sama dengan MCP?

Adakah ini bermaksud SEO sudah berakhir?

Adakah laman web perlu dibina semula sekarang untuk ejen AI?

Mengapa trafik bot meningkat begitu besar apabila ejen terlibat?

Kesimpulan

Jika anda mengendalikan laman web hari ini, tiada sebab untuk panik dan membina semula semuanya di sekitar WebMCP esok. Tetapi anda patut mula menyemak sekarang sama ada kandungan anda berstruktur, pantas, machine-readable, dan boleh diakses dengan bersih.

Itulah yang akan menentukan sama ada, dalam masa depan yang agentic, laman anda hanya kelihatan baik atau benar-benar boleh digunakan oleh sistem yang akan menjadi penting.

Cheers, Joe

Sumber dan bacaan lanjut

- TechCrunch: Cloudflare CEO says online bot traffic will exceed human traffic by 2027

- Chrome for Developers: WebMCP Early Preview Program

- Chrome for Developers: When to use WebMCP and MCP

- WebMCP Draft

- Alphabet: Q4 2025 Earnings Release

- Meta: Q4 2025 Results

- Stack Overflow Data Licensing

- Prosus HY2026 Summary Consolidated Financial Statements

Sampai jumpa lagi,

Joe