WebMCP کی وضاحت: AI agents ویب کو بدل رہے ہیں

فہرستِ مضامین

مارچ 2026 میں Cloudflare کے CEO Matthew Prince نے SXSW میں کہا کہ 2027 تک bot traffic انسانی traffic سے زیادہ ہو سکتا ہے۔ اس کے پیچھے منطق سادہ ہے: ایک انسان چند tabs کھولتا ہے۔ ایک agent اسی کام کے لیے parallel میں سینکڑوں یا ہزاروں requests بھیج سکتا ہے، sources compare کر سکتا ہے، اور actions تیار کر سکتا ہے۔

بہت سے operators کے لیے bots اب تک بنیادی طور پر security problem تھے: scrapers، spam، اور DDoS attacks ۔ لیکن browser agents اور AI workflows کے ساتھ اب ایک دوسری category بھی سامنے آ رہی ہے: ایسے bots جو کچھ توڑنے نہیں، بلکہ پڑھنے، evaluate کرنے، اور آپ کی طرف سے act کرنے کے لیے آتے ہیں۔

یہیں WebMCP دلچسپ ہو جاتا ہے۔ یہ کوئی مکمل تیار شدہ نیا web standard نہیں، بلکہ ایک early concept ہے کہ websites اور browser کے اندر موجود agents زیادہ structured طریقے سے کیسے interact کر سکتے ہیں۔

WebMCP کیا ہے؟

WebMCP ایک early approach ہے جو websites کو browser کے اندر agent کے سامنے explicit capabilities اور context expose کرنے دیتا ہے۔ یعنی agent کو صرف HTML سے اندازہ نہیں لگانا پڑتا، یا DOM scraping کے ذریعے مشکل سے button اور forms سمجھنے کی ضرورت نہیں رہتی؛ website زیادہ صاف طریقے سے بتا سکتی ہے کہ کون سی actions available ہیں۔

اس کی بنیادی idea سیدھی ہے:

- Website صرف visual interface نہیں، بلکہ structured capabilities expose کرتی ہے۔

- Agent browser context کے اندر ان capabilities کو زیادہ درست طریقے سے use کر سکتا ہے۔

- User tab کے flow میں رہتا ہے، ہر step manually click نہیں کرنا پڑتا۔

یہاں اہم بات درست framing ہے: اپریل 2026 تک WebMCP نہ تو ratified W3C standard ہے اور نہ ہی broadly available browser feature۔ یہ ابھی بھی draft یا preview stage کی ایک direction ہے جس پر Chrome publicly discussion اور experimentation کر رہا ہے۔

MCP اور WebMCP میں فرق کیا ہے؟

یہ وہ جگہ ہے جہاں بہت سی discussions غیر واضح ہو جاتی ہیں۔ WebMCP صرف “websites کے لیے MCP” نہیں ہے، اور نہ ہی MCP کا direct successor ہے۔

- MCP عمومی طور پر بتاتا ہے کہ models اور clients tools، data sources، اور services کے ساتھ کیسے interact کر سکتے ہیں۔

- WebMCP اس مخصوص case سے متعلق ہے جہاں ایک agent browser کے اندر website کے ساتھ interact کرتا ہے۔

- اس لیے MCP اور WebMCP related لیکن مختلف مسائل حل کرتے ہیں۔

یہ distinction ضروری ہے۔ ورنہ یہ impression بنانا آسان ہو جاتا ہے کہ پورا open web بہت جلد ایک نئے standard پر shift ہونے والا ہے۔ ہم ابھی وہاں نہیں پہنچے۔

2027 تک bot traffic اتنا کیوں بڑھ سکتا ہے؟

اس کا بنیادی نکتہ وہی fan-out effect ہے جس کا ذکر Prince نے کیا۔ اگر آپ آج ایک laptop تلاش کر رہے ہیں، تو شاید 5 سے 10 pages کھولیں گے۔ لیکن ایک agent اسی task کو parallel work میں تقسیم کر سکتا ہے:

- ایک ہی وقت میں کئی retailers کو check کرتا ہے۔

- Shipping time، pricing، return policy، اور warranty compare کرتا ہے۔

- Duplicate، ads، اور irrelevant results filter کرتا ہے۔

- Raw browsing noise کے بجائے decision summary واپس کرتا ہے۔

Requests کی exact تعداد task پر depend کرتی ہے۔ لیکن direction واضح ہے: agents ہر user کے لیے query volume کو multiply کر دیتے ہیں، کیونکہ وہ parallel کام کرتے ہیں اور انسان کے مقابلے میں زیادہ intermediate steps automate کرتے ہیں۔

میری ذاتی تبدیلی: searching سے delegating تک

میں خود اس تبدیلی کو اپنے workflow میں واضح طور پر محسوس کر رہا ہوں۔ پہلے research کا مطلب ہوتا تھا query لکھنا، تین سے دس tabs کھولنا، خراب content نکالنا، query refine کرنا، اور پھر دوبارہ شروع کرنا۔ اب میں اس کام کا بڑا حصہ delegate کر دیتا ہوں۔

میری روزمرہ routine کی ایک concrete مثال: جب میں نئے hardware، security updates، یا tools میں تبدیلیاں track کرتا ہوں، تو صرف one-off searches نہیں کرتا۔ میرے agents ان topics کو بار بار check کرتے ہیں، filter کرتے ہیں، اور prioritize کرتے ہیں۔ جو چیز critical ہو وہ سیدھی میرے phone پر push alert کے طور پر آتی ہے۔ کم urgent چیزیں dashboard یا reading list میں چلی جاتی ہیں۔

فرق صرف convenience کا نہیں ہے۔ اصل فرق یہ ہے کہ ایسے setups مسلسل traffic generate کرتے ہیں، حتیٰ کہ جب میں actively browsing نہیں کر رہا ہوتا۔ یہی بات سمجھانے کے لیے کافی ہے کہ bot traffic statistical طور پر human sessions کے مقابلے میں کہیں زیادہ تیزی سے کیوں بڑھ سکتا ہے۔

Websites اور SEO کے لیے اس کا کیا مطلب ہے؟

میں نہیں سمجھتا کہ classic SEO “ختم” ہو گیا ہے۔ لیکن مجھے یہ بہت ممکن لگتا ہے کہ اسے ایک نئی layer کے ساتھ complement کیا جائے گا۔ اب صرف search engines کا آپ کے content کو سمجھنا کافی نہیں ہے۔ Agents کو بھی content extract، compare، اور اپنے context میں integrate کرنا پڑے گا۔

اس next layer کے لیے چار چیزیں خاص طور پر اہم ہیں:

- صاف structure: headings، tables، forms، اور semantic HTML واضح ہونا چاہیے۔

- Machine-readable data: Schema.org، consistent metadata، اور clearly named fields decorative marketing copy سے زیادہ اہم ہیں۔

- Accessible flows: اگر اہم information یا actions brittle JavaScript کے پیچھے hidden ہیں، تو agents غیر ضروری طور پر slow ہو جاتے ہیں۔

- Latency اور reliability: وہ sites جو تیزی، stability، اور predictability کے ساتھ respond کرتی ہیں، technical advantage حاصل کریں گی۔

اس context میں AEO (Agent Engine Optimization) کی اصطلاح زیادہ سننے کو ملے گی۔ میں اسے SEO کا replacement نہیں سمجھتا، بلکہ agentic systems کے لیے ایک additional visibility discipline سمجھتا ہوں۔

Operators کو ابھی کیا کرنا چاہیے؟

اگر آپ آج کوئی website، portal، یا application چلا رہے ہیں، تو میں hype سے نہیں شروع کروں گا۔ میں hygiene سے شروع کروں گا:

- Structured data بڑھائیں۔ دیکھیں کہ

Schema.orgکہاں پہلے ہی sense بناتا ہے: articles، products، FAQs، organization data، breadcrumbs۔ - اہم content کو unnecessary friction کے بغیر reachable بنائیں۔ Price، availability، specifications، contact paths، اور core functionality fragile UI tricks کے پیچھے نہیں ہونی چاہیے۔

- Forms اور interaction flows کو simplify کریں۔ Clear labels، stable buttons، predictable states، اور clean HTML انسانوں اور agents دونوں کے لیے بہتر ہیں۔

- Performance کو سختی سے measure کریں۔ Slow response times، unnecessary redirects، اور unstable frontends visibility اور usability دونوں کم کرتے ہیں۔

- Bot traffic کو درست طریقے سے الگ کریں۔ ہر bot malicious نہیں ہوتا، لیکن ہر bot valuable بھی نہیں ہوتا۔ Monitoring، rate limits، اور clear policies زیادہ اہم ہوتے جائیں گے۔

- جہاں business sense بنتا ہو وہاں structured access دیں۔ یہ API، feed، clean metadata، یا future میں زیادہ agent-friendly browser flow کی شکل میں ہو سکتا ہے۔

اگر clicks agents کریں گے تو internet کا خرچ کون اٹھائے گا؟

یہ economic question technical question جتنا ہی دلچسپ ہے۔ Alphabet نے Q4 2025 میں 82.3 billion dollars advertising revenue report کیا، جبکہ Meta نے اسی period میں تقریباً 58.1 billion dollars report کیے۔ یہ numbers ایک بات بہت صاف کرتے ہیں: آج کا web ابھی بھی attention، clicks، اور ad inventory پر deeply dependent ہے۔

اگر users increasingly agents کے ذریعے answers consume کریں، خود pages visit کیے بغیر، تو موجودہ model پر pressure پڑے گا۔ اس کا یہ مطلب نہیں کہ advertising فوراً ختم ہو جائے گی۔ لیکن یہ ضرور ظاہر کرتا ہے کہ direct access، data licensing، APIs، اور subscription-style models زیادہ اہم ہو سکتے ہیں۔

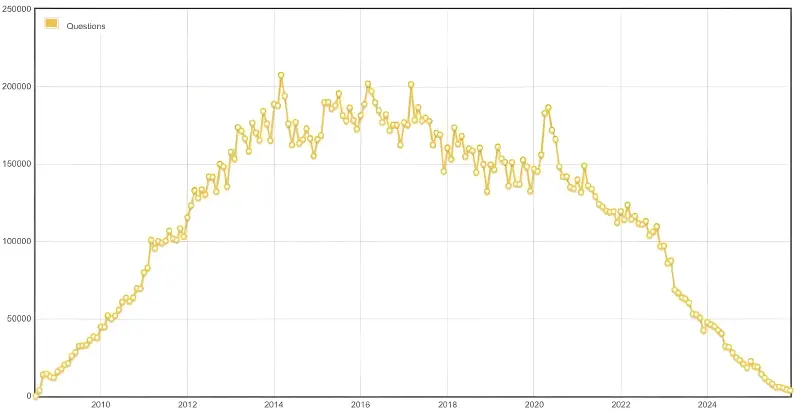

اس direction میں ایک interesting signal Stack Overflow سے آتا ہے۔ AI boom کے بعد سے نئے questions کا volume واضح pressure میں ہے، جبکہ company اپنی knowledge base اور data licensing کو زیادہ aggressively product کے طور پر position کر رہی ہے۔ یہ ابھی کسی universal new model کو prove نہیں کرتا، لیکن direction ضرور دکھاتا ہے: future value صرف pageviews سے نہیں، بلکہ licensed, structured access to knowledge سے بھی آ سکتی ہے۔

FAQ

کیا WebMCP ابھی official web standard ہے؟

کیا WebMCP اور MCP ایک ہی چیز ہیں؟

کیا اس کا مطلب SEO ختم ہو گیا؟

کیا websites کو ابھی فوراً AI agents کے لیے rebuild کرنا چاہیے؟

Agents آنے پر bot traffic اتنا کیوں بڑھ جاتا ہے؟

نتیجہ

اگر آپ آج کوئی website چلا رہے ہیں تو panic کرنے یا کل ہی سب کچھ WebMCP کے گرد rebuild کرنے کی ضرورت نہیں ہے۔ لیکن ابھی سے یہ دیکھنا دانشمندانہ ہے کہ آپ کا content structured، fast، machine-readable، اور cleanly accessible ہے یا نہیں۔

یہی چیز طے کرے گی کہ agentic future میں آپ کی site صرف خوبصورت نظر آئے گی یا واقعی ان systems کے لیے usable ہوگی جو اہم ہوں گے۔

Cheers, Joe

Sources and further reading

- TechCrunch: Cloudflare CEO says online bot traffic will exceed human traffic by 2027

- Chrome for Developers: WebMCP Early Preview Program

- Chrome for Developers: When to use WebMCP and MCP

- WebMCP Draft

- Alphabet: Q4 2025 Earnings Release

- Meta: Q4 2025 Results

- Stack Overflow Data Licensing

- Prosus HY2026 Summary Consolidated Financial Statements

اگلی بار تک،

Joe