شرح WebMCP: وكلاء الذكاء الاصطناعي يغيّرون الويب

جدول المحتويات

في مارس 2026 قال ماثيو برينس، الرئيس التنفيذي لـ Cloudflare، في SXSW إن حركة البوتات قد تتجاوز حركة البشر بحلول 2027. المنطق وراء هذا الطرح واضح: الإنسان يفتح بضع تبويبات. أما الوكيل فيمكنه إطلاق مئات أو آلاف الطلبات بالتوازي للمهمة نفسها، ومقارنة المصادر، وتجهيز الإجراءات.

بالنسبة لكثير من المشغّلين، كانت البوتات تعني أساسا مشكلة أمنية: Scrapers وSpam و هجمات DDoS . ومع وكلاء المتصفح وعمليات العمل المعتمدة على الذكاء الاصطناعي، ظهرت الآن فئة ثانية: بوتات لا تحاول التخريب، بل القراءة والتحليل والتصرف نيابة عنك.

وهنا بالضبط يصبح WebMCP مهما. ليس كمعيار ويب جديد مكتمل، بل كمفهوم مبكر لكيف يمكن للمواقع ووكلاء المتصفح أن يتفاعلوا بطريقة أكثر تنظيما.

ما هو WebMCP؟

WebMCP هو توجه مبكر يسمح للمواقع بأن تعرض قدرات وسياقا واضحين لوكيل يعمل داخل المتصفح. بدلا من أن يضطر الوكيل إلى تخمين كل شيء من HTML ومحاولة فهم الأزرار أو النماذج عبر DOM scraping، يمكن للموقع أن يصف بشكل أوضح ما هي الإجراءات المتاحة.

الفكرة الأساسية بسيطة:

- الموقع يعرض قدرات منظّمة بدلا من الاكتفاء بواجهة مرئية.

- الوكيل يستطيع استخدام هذه القدرات بدقة أكبر داخل سياق المتصفح.

- المستخدم يبقى داخل تدفق التبويب بدلا من النقر يدويا على كل خطوة.

والنقطة المهمة هنا هي التوصيف الصحيح: حتى أبريل 2026، لا يُعد WebMCP معيار W3C مُعتمدا، ولا ميزة متاحة على نطاق واسع في المتصفحات. ما زلنا نتحدث عن اتجاه مبكر في صورة draft أو preview، يناقشه Chrome ويختبره علنا.

ما الفرق بين MCP وWebMCP؟

هنا تصبح كثير من النقاشات غير دقيقة. WebMCP ليس ببساطة “MCP للمواقع”، وليس أيضا الخليفة المباشر لـ MCP.

- MCP يصف بشكل عام كيف يمكن للنماذج والعملاء التواصل مع الأدوات ومصادر البيانات والخدمات.

- WebMCP يتعامل مع الحالة الخاصة التي يتفاعل فيها الوكيل مع موقع ويب داخل المتصفح.

- MCP وWebMCP يحلان مشاكل مترابطة، لكنهما ليسا الشيء نفسه.

هذا التفريق مهم، وإلا فمن السهل أن ينشأ انطباع بأن الويب المفتوح كله على وشك الانتقال دفعة واحدة إلى معيار جديد واحد. لم نصل إلى هذه المرحلة.

لماذا قد ترتفع حركة البوتات بقوة بحلول 2027؟

النقطة الجوهرية هي تأثير fan-out الذي وصفه برينس. إذا كنت تبحث اليوم عن حاسوب محمول، فقد تفتح 5 إلى 10 صفحات. أما الوكيل فيمكنه تقسيم المهمة نفسها إلى عمل متواز:

- يفحص عدة متاجر في الوقت نفسه.

- يقارن أوقات الشحن والأسعار وسياسات الإرجاع والضمان.

- يزيل النتائج المكررة والإعلانات والنتائج غير ذات الصلة.

- يعيد لك ملخصا قراريا بدلا من ضجيج التصفح.

عدد الطلبات الفعلي يعتمد طبعا على المهمة. لكن الاتجاه واضح: الوكلاء يضاعفون عدد الاستعلامات لكل مستخدم لأنهم يعملون بالتوازي ويؤتمتون خطوات وسيطة أكثر بكثير مما يفعله الإنسان.

تحولي الشخصي: من البحث إلى التفويض

أنا شخصيا أشعر بهذا التحول بوضوح في طريقة عملي. سابقا كان البحث يعني كتابة استعلام، وفتح ثلاث إلى عشر تبويبات، والتخلص من المحتوى الرديء، ثم تعديل الاستعلام والبدء من جديد. اليوم أنا أفوض جزءا كبيرا من هذا العمل.

مثال عملي من روتيني اليومي: عندما أتابع عتادا جديدا أو تحديثات أمنية أو تغييرات في الأدوات، لا أجري مجرد بحث لمرة واحدة. لدي وكلاء يعيدون فحص هذه المواضيع، ويصفّونها، ويرتبونها حسب الأولوية. التنبيهات الحرجة تصل مباشرة إلى هاتفي. أما الأقل إلحاحا فتذهب إلى Dashboard أو إلى قائمة قراءة لوقت لاحق.

الفرق ليس فقط في الراحة. الفرق الحقيقي هو أن مثل هذه الإعدادات تولد حركة مرور بشكل مستمر حتى عندما لا أكون أتصفح بشكل نشط. وهذا وحده يوضح لماذا يمكن لحركة البوتات أن تنمو إحصائيا بسرعة أكبر بكثير من جلسات البشر.

ماذا يعني هذا للمواقع ولـ SEO؟

لا أعتقد أن SEO التقليدي “مات”. لكنني أرى أنه من المرجح جدا أن يتم استكماله بطبقة جديدة. لم يعد كافيا أن تفهم محركات البحث محتواك. بشكل متزايد، سيحتاج الوكلاء أيضا إلى استخراج هذا المحتوى ومقارنته ودمجه في سياقهم الخاص.

بالنسبة لهذه الطبقة الجديدة، هناك أربع نقاط أساسية:

- بنية نظيفة: العناوين والجداول والنماذج وHTML الدلالي يجب أن تكون واضحة بلا لبس.

- بيانات قابلة للقراءة آليا: Schema.org والبيانات الوصفية المتسقة والحقول المسماة بوضوح أهم من نصوص تسويقية مزخرفة.

- تدفقات سهلة الوصول: إذا كانت المعلومات أو الإجراءات المهمة مخفية خلف JavaScript هش، فسيتم إبطاء الوكلاء بلا داع.

- الكمون والاعتمادية: المواقع التي تستجيب بسرعة وثبات وبصورة متوقعة ستكون لها أفضلية تقنية.

ستسمع أيضا مصطلح AEO (Agent Engine Optimization) أكثر فأكثر في هذا السياق. وأنا لا أراه بديلا عن SEO، بل تخصصا إضافيا للظهور في عالم الأنظمة الوكيلة.

ماذا ينبغي على المشغّلين فعله الآن؟

إذا كنت تدير موقعا أو بوابة أو تطبيقا اليوم، فأنا لن أبدأ من الضجة. سأبدأ من الأساسيات:

- وسّع البيانات المنظمة. راجع أين يكون

Schema.orgمنطقيا: المقالات، المنتجات، FAQ، بيانات المؤسسة، وBreadcrumbs. - اجعل المحتوى المهم متاحا من دون احتكاك غير ضروري. الأسعار والتوفر والمواصفات وطرق التواصل والوظائف الأساسية لا ينبغي أن تكون مخفية وراء حيل واجهة هشة.

- بسّط النماذج ومسارات التفاعل. Labels واضحة، وأزرار مستقرة، وحالات متوقعة، وHTML نظيف يساعد البشر والوكلاء معا.

- قِس الأداء بصرامة. بطء الاستجابة، والـ redirects غير الضرورية، والواجهات الأمامية غير المستقرة، كلها تقلل من الظهور وقابلية الاستخدام.

- افصل حركة البوتات بشكل صحيح. ليس كل بوت خبيثا، لكن ليس كل بوت ذا قيمة أيضا. Monitoring وRate Limits والسياسات الواضحة ستصبح أهم.

- قدّم وصولا منظما عندما يكون ذلك منطقيا تجاريا. قد يكون ذلك عبر API أو Feed أو Metadata نظيفة أو مستقبلا عبر تدفق متصفح أكثر ملاءمة للوكلاء.

من سيدفع تكلفة الإنترنت إذا كانت الوكلاء هي من تنقر؟

السؤال الاقتصادي لا يقل إثارة عن السؤال التقني. فقد أعلنت Alphabet عن 82.3 مليار دولار من إيرادات الإعلانات في الربع الرابع من 2025، بينما أعلنت Meta عن حوالي 58.1 مليار دولار في الفترة نفسها. هذه الأرقام توضح أمرا واحدا بجلاء: الويب الحالي لا يزال معتمدا بعمق على الانتباه والنقرات والمخزون الإعلاني.

إذا بدأ المستخدمون بشكل متزايد في استهلاك الإجابات عبر الوكلاء بدلا من زيارة الصفحات بأنفسهم، فهذا يضع النموذج الحالي تحت ضغط. هذا لا يعني تلقائيا أن الإعلانات ستختفي. لكنه يعني أن الوصول المباشر وترخيص البيانات وواجهات API والنماذج الشبيهة بالاشتراكات قد تصبح أكثر أهمية.

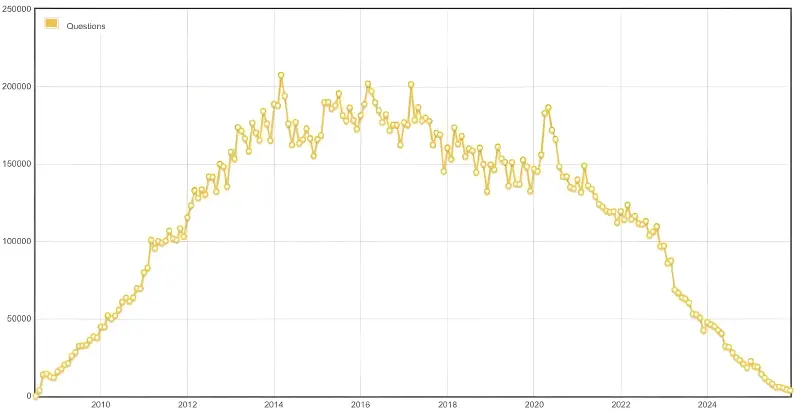

وهناك إشارة مثيرة للاهتمام في هذا الاتجاه من Stack Overflow. فحجم الأسئلة الجديدة أصبح تحت ضغط واضح منذ طفرة الذكاء الاصطناعي، بينما بدأت الشركة في تقديم قاعدة المعرفة وترخيص البيانات لديها بشكل أكثر هجومية كمنتج. هذا لا يثبت بعد نموذجا كونيا جديدا، لكنه يشير إلى اتجاه: القيمة قد تأتي مستقبلا ليس فقط من pageviews، بل أيضا من وصول منظّم ومرخّص إلى المعرفة.

FAQ

هل WebMCP أصبح بالفعل معيار ويب رسمي؟

هل WebMCP هو نفسه MCP؟

هل يعني هذا نهاية SEO؟

هل تحتاج المواقع إلى إعادة بناء فورية من أجل وكلاء الذكاء الاصطناعي؟

لماذا ترتفع حركة البوتات بهذا الشكل عندما تدخل الوكلاء في الصورة؟

الخلاصة

إذا كنت تدير موقعا اليوم، فلا داعي للذعر أو لإعادة بناء كل شيء حول WebMCP غدا. لكن من المنطقي أن تبدأ الآن في التحقق مما إذا كان محتواك منظّما وسريعا وقابلا للقراءة آليا وسهل الوصول بشكل نظيف.

هذا هو ما سيحدد ما إذا كان موقعك في مستقبل تقوده الوكلاء مجرد موقع جميل شكلا، أم موقعا قابلا للاستخدام فعلا من قبل الأنظمة التي ستهم.

Cheers, Joe

المصادر وقراءات إضافية

- TechCrunch: Cloudflare CEO says online bot traffic will exceed human traffic by 2027

- Chrome for Developers: WebMCP Early Preview Program

- Chrome for Developers: When to use WebMCP and MCP

- WebMCP Draft

- Alphabet: Q4 2025 Earnings Release

- Meta: Q4 2025 Results

- Stack Overflow Data Licensing

- Prosus HY2026 Summary Consolidated Financial Statements

حتى المرة القادمة، جو