WebMCP: как AI-агенты меняют веб

Содержание

В марте 2026 года гендиректор Cloudflare Мэттью Принс заявил на SXSW, что к 2027 году бот-трафик может превысить человеческий трафик. Логика здесь вполне понятна: человек открывает несколько вкладок. Агент же может параллельно отправить сотни или тысячи запросов для той же задачи, сравнить источники и подготовить действия.

Для многих операторов боты до сих пор были в первую очередь проблемой безопасности: скрейперы, спам и DDoS-атаки . Но с ростом браузерных агентов и сценариев работы с ИИ появляется вторая категория: боты, которые не ломают, а читают, оценивают и действуют от вашего имени.

Именно здесь становится интересен WebMCP. Не как готовый новый веб-стандарт, а как ранняя концепция того, как сайты и агенты в браузере могут взаимодействовать более структурированно.

Что такое WebMCP?

WebMCP — это ранний подход, который позволяет сайтам раскрывать явные возможности и контекст для агента в браузере. Вместо того чтобы заставлять агента гадать по HTML и с трудом интерпретировать кнопки и формы через DOM-скрейпинг, сайт может гораздо яснее описать, какие действия доступны.

Базовая идея проста:

- Сайт публикует структурированные возможности, а не только визуальный интерфейс.

- Агент может использовать эти возможности точнее в контексте браузера.

- Пользователь остается в потоке вкладки, а не прокликивает каждый шаг вручную.

Важно правильно это квалифицировать: по состоянию на апрель 2026 года WebMCP не является утвержденным стандартом W3C и не является широко доступной функцией браузеров. Это пока раннее направление на стадии черновика и ранних публичных экспериментов, которое Chrome открыто обсуждает и тестирует.

В чем разница между MCP и WebMCP?

Именно здесь многие разговоры становятся неточными. WebMCP — это не просто “MCP для сайтов” и не прямой преемник MCP.

- MCP в общем виде описывает, как модели и клиенты могут взаимодействовать с инструментами, источниками данных и сервисами.

- WebMCP относится к конкретному случаю, когда агент взаимодействует с сайтом внутри браузера.

- То есть MCP и WebMCP решают связанные, но разные задачи.

Это различие важно. Иначе легко создать впечатление, будто весь открытый веб скоро массово переедет на один новый стандарт. До этого еще далеко.

Почему бот-трафик может сильно вырасти к 2027 году?

Ключевая идея — это веерный эффект распараллеливания, о котором говорил Принс. Если сегодня вы ищете ноутбук, вы, возможно, откроете 5–10 страниц. Агент же может разбить ту же задачу на параллельную работу:

- Проверить сразу несколько магазинов.

- Сравнить сроки доставки, цены, условия возврата и гарантии.

- Отфильтровать дубли, рекламу и нерелевантные результаты.

- Вернуть не шум браузинга, а сжатую выжимку для принятия решения.

Точное число запросов зависит от задачи. Но направление очевидно: агенты кратно увеличивают число запросов на одного пользователя, потому что работают параллельно и автоматизируют больше промежуточных шагов, чем человек.

Мой личный сдвиг: от поиска к делегированию

Я уже очень явно чувствую этот сдвиг в собственной работе. Раньше исследование часто означало: ввести запрос, открыть от трех до десяти вкладок, выкинуть мусорный контент, уточнить запрос и начать заново. Сегодня значительную часть этой работы я делегирую.

Конкретный пример из моего повседневного рабочего процесса: когда я отслеживаю новое железо, обновления безопасности или изменения в инструментах, я не ограничиваюсь разовым поиском. У меня есть агенты, которые регулярно проверяют эти темы, фильтруют их и расставляют приоритеты. Критичное сразу приходит уведомлением на телефон. Менее срочное уходит в панель обзора или в список для чтения на потом.

Разница не только в удобстве. Главное в том, что такие связки генерируют трафик постоянно, даже когда я сам активно не просматриваю веб. Уже этого достаточно, чтобы понять, почему бот-трафик может статистически расти гораздо быстрее, чем человеческие сессии.

Что это означает для сайтов и SEO?

Я не думаю, что классическое SEO “умерло”. Но я вполне допускаю, что оно будет дополнено новым слоем. Уже недостаточно того, чтобы поисковики понимали ваш контент. Все чаще его также должны будут извлекать, сравнивать и встраивать в свой контекст сами агенты.

Для этого следующего слоя особенно важны четыре вещи:

- Четкая структура: заголовки, таблицы, формы и семантический HTML должны быть однозначными.

- Машиночитаемые данные: Schema.org, консистентные метаданные и четко названные поля важнее, чем декоративный маркетинговый текст.

- Доступные сценарии: если важная информация или действия спрятаны за хрупким JavaScript, агенты будут без необходимости тормозиться.

- Задержка и надежность: сайты, которые отвечают быстро, стабильно и предсказуемо, получают техническое преимущество.

В этом контексте вы все чаще будете слышать термин AEO (Agent Engine Optimization). Я бы не рассматривал его как замену SEO, а скорее как дополнительную дисциплину видимости для агентных систем.

Что операторам стоит делать уже сейчас

Если вы сегодня управляете сайтом, порталом или приложением, я бы начинал не с хайпа, а с базовой технической гигиены:

- Расширяйте структурированные данные. Посмотрите, где

Schema.orgуже уместен: статьи, продукты, FAQ, данные об организации, хлебные крошки. - Сделайте важный контент доступным без лишних барьеров. Цены, наличие, спецификации, каналы связи и ключевая функциональность не должны быть спрятаны за хрупкими UI-трюками.

- Упрощайте формы и пользовательские сценарии. Четкие метки, стабильные кнопки, предсказуемые состояния и чистый HTML помогают и людям, и агентам.

- Жестко измеряйте производительность. Медленные ответы, лишние редиректы и нестабильные фронтенды снижают и видимость, и удобство использования.

- Корректно отделяйте бот-трафик. Не каждый бот вредоносен, но и не каждый бот ценен. Мониторинг, ограничения скорости и четкие политики становятся важнее.

- Давайте структурированный доступ там, где это оправдано бизнесом. Это может быть API, фид, чистые метаданные или в будущем более удобный для агентов браузерный сценарий.

Кто будет платить за интернет, если кликать будут агенты?

Экономический вопрос как минимум не менее интересен, чем технический. Alphabet сообщила о 82,3 млрд долларов рекламной выручки за Q4 2025, а Meta — примерно о 58,1 млрд долларов за тот же период. Эти цифры очень ясно показывают одну вещь: сегодняшний веб по-прежнему глубоко завязан на внимание, клики и рекламный инвентарь.

Если пользователи все чаще будут получать ответы через агентов вместо того, чтобы сами заходить на страницы, это начнет давить на текущую модель. Это не означает автоматически, что реклама исчезнет. Но это означает, что прямой доступ, лицензирование данных, API и подписочные модели могут стать важнее.

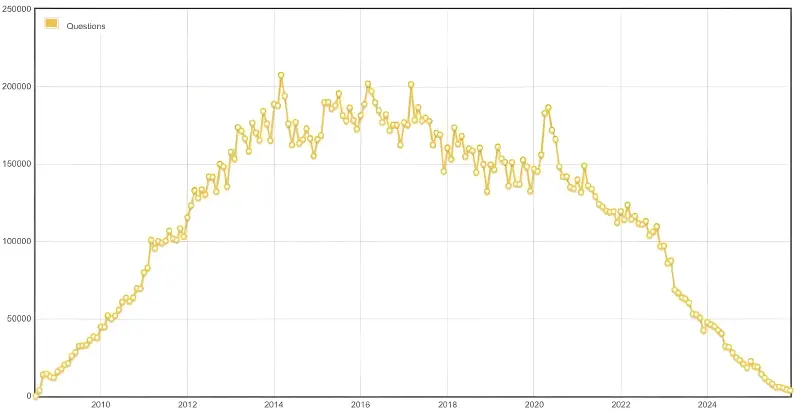

Интересный сигнал в эту сторону дает Stack Overflow. Объем новых вопросов находится под заметным давлением с момента бума ИИ, а сама компания все активнее позиционирует свою базу знаний и лицензирование данных как продукт. Это пока не доказывает существование новой универсальной модели, но направление показывает: ценность в будущем может все больше приходить не только из просмотров страниц, но и из лицензированного структурированного доступа к знаниям.

FAQ

Является ли WebMCP уже официальным веб-стандартом?

WebMCP — это то же самое, что MCP?

Значит ли это конец SEO?

Нужно ли уже сейчас перестраивать сайты под AI-агентов?

Почему бот-трафик так сильно растет, когда в процесс входят агенты?

Вывод

Если вы управляете сайтом сегодня, нет причин паниковать и завтра же перестраивать все вокруг WebMCP. Но уже сейчас стоит проверить, насколько ваш контент структурирован, быстр, машиночитаем и доступен без лишних препятствий.

Именно это определит, будет ли ваш сайт в агентном будущем просто красиво выглядеть или действительно окажется полезным для систем, которые будут иметь значение.

Cheers, Joe

Источники и ссылки

- TechCrunch: Cloudflare CEO says online bot traffic will exceed human traffic by 2027

- Chrome for Developers: WebMCP Early Preview Program

- Chrome for Developers: When to use WebMCP and MCP

- WebMCP Draft

- Alphabet: Q4 2025 Earnings Release

- Meta: Q4 2025 Results

- Stack Overflow Data Licensing

- Prosus HY2026 Summary Consolidated Financial Statements

До следующего раза,

Joe